保护乘客还是行人?你来帮无人驾驶汽车决定!

无人驾驶汽车紧急情况下撞狗还是撞罪犯?撞婴儿还是撞老人?人工智能全权处理这种问题显然不够让人放心,麻省理工(MIT)则想到一个好主意——把道德选择进行众包。

近日,麻省理工学院发布了一款名为 “道德机器(Moral Machine)” 的调查平台,采集用户对于无人驾驶汽车的道德倾向,以作为研究未来无人车道德决策的数据样本。

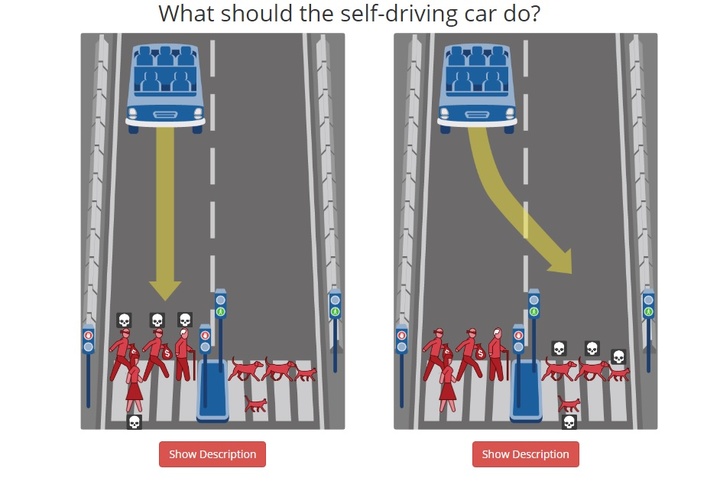

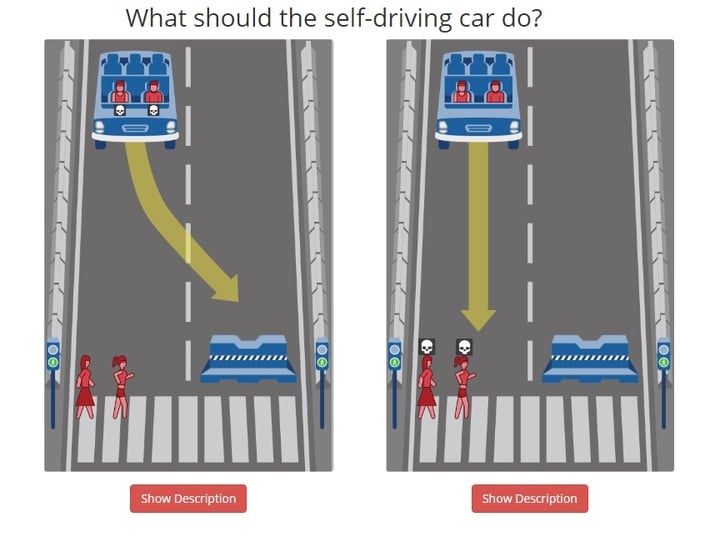

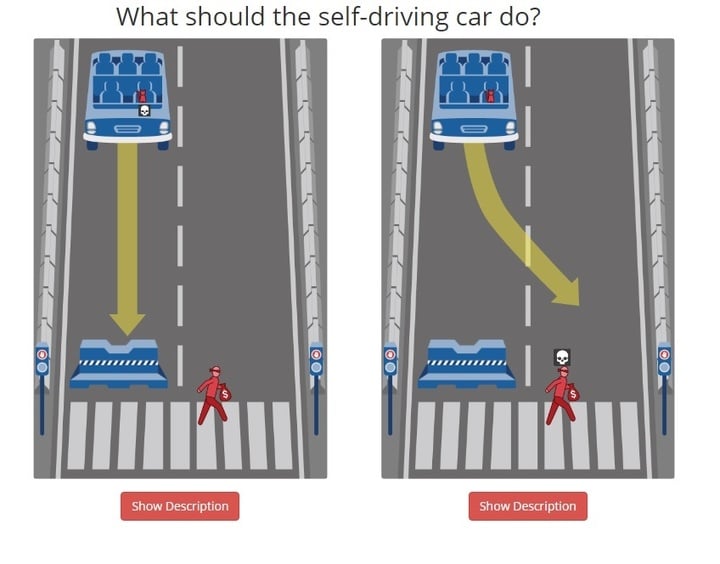

被调查者要经受一系列考验,以确定各个道德维度上的倾向。比如,刹车失灵时,是撞死闯红灯的行人,还是绿灯通过的猫和狗。

还有附带性别倾向的题目:是保护过马路的女性,还是保护车上的男性?

还有这种极个别情况:是保护车上的猫还是撞死罪犯?

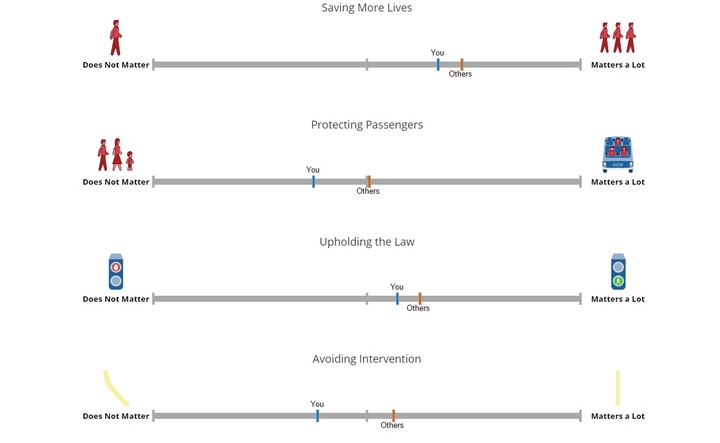

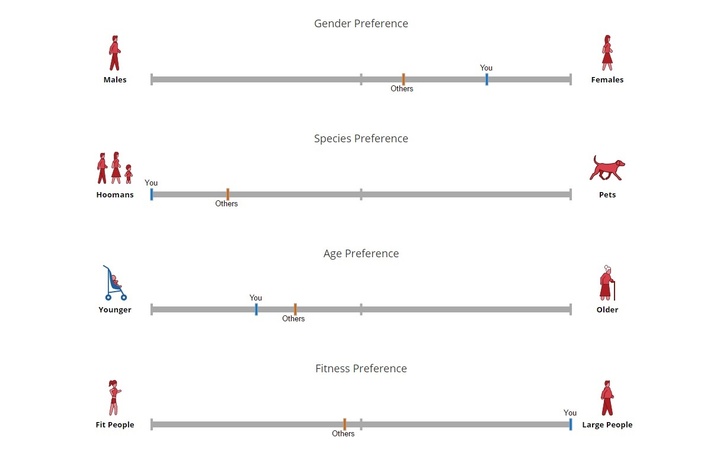

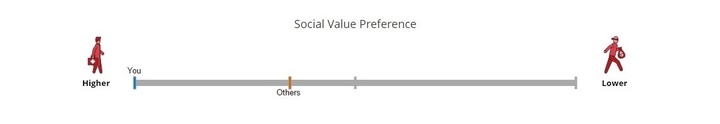

爱范儿(微信号:ifanr)也参加了测试,得出的道德倾向从 9 个维度上进行解释,比如,年龄倾向、物种倾向、是否遵纪守法、保护乘客还是行人等等。

此外,受访者还可以自己创造其他情形,并浏览其他人的创造的道德抉择。MIT 希望通过这种方式尽可能多的覆盖可能的情况。

MIT 表示,当今的人工智能在为人类提供越来越多的支持,在某些领域甚至有代替人类的倾向。在可见的未来,驾驶就是一项可以被机器替代的工作。

机器在未来不可避免地要自行做出平常人类才会面对的道德抉择,有些情况下,还会牵扯到人的生命。

在紧要关头该保护谁,该抛弃谁,这是这个社会不愿面对,但是必须要解决的问题。

我们也看到,在测试过程中,歧视、法律观念等等平常我们避而不谈的价值观争议被暴露无遗。而想要进一步推进无人驾驶,社会上的每个人都需要正视这些丑陋的现实,并为未来无人驾驶的道德决断提供一个普世的准则。

MIT 面对这个难题,选择了一条可能是最公正的路径——让成千上万的公众自己决定。

图片来自:Moral Machine

题图来自:The Daily Dot

爱范儿招聘新创组记者,简历请发 [email protected]

职位要求:

- 至少 1 年媒体从业经验;

- 熟悉主流技术创新以及高速成长中的新技术、新模式,了解产业趋势以及技术如何影响人;

- 能用有趣、浅显的语言解读新技术;

- 无障碍地阅读外媒新闻

工作职责:

-

负责新创领域(新产品、新技术、新模式)的报道;

-

面对热点事件,独立操作大型或深度选题,包括策划、采访和写作