Google Pixel 2 的视频稳定能力是如何获得的?Google 亲自来解答

从 Nexus 6P 和 Nexus 5X 开始,Google 自家手机的拍照能力比前代有了明显的提升,而在这之前的 Google 亲儿子系列的拍照能力,不提也罢。

![]()

到了改朝换代的第一代 Google Pixel 时,亲儿子的拍照实力可以说有了一个质的飞跃,当时在 DXOMark 上的评分以及本身的拍照能力,也已经是可以俯视一众对手。

![]()

而刚刚发布不久的 Google Pixel 2 也是拿下了目前为止智能手机拍照的最高分 98 分,对于 Google 来说,硬件从来不是最拿手的,但软件和算法却可以弥补甚至提升拍照的体验。

Google 相机中的 HDR+ 算法,则是具有代表性的一个,通过 Google Camera 相机应用,可以让手机获得比自带相机更好的拍照效果。

![]()

除了拍照,Google 还为 Pixel 的摄像能力加入了“视频稳定技术”,在一年前的初代 Pixel 上,我就曾体验过那种神奇的效果。

(初代 Pixel 的视频画面虽然稳定,但是很像机器人视角)

但是,在初代 Pixel 上实现的稳定效果,完全是通过软件达成的,因此,虽然能获得极强的稳定性,但整个画面看起来却非常的奇怪,有点像机器人的感觉。

而不少人也把这个现象叫做“Terminator effect”(终结者现象),我只能说形容的非常贴切。

在 Google Pixel 2 上,这个现象被很大程度的改善了,而其拍出来视频的稳定性确实比前代更好,而且画面看起来也更加的自然了。

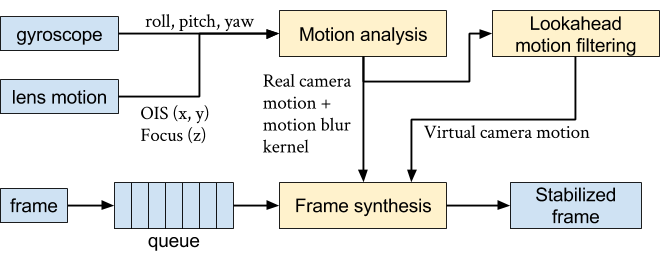

那么要用手机拍出如此稳定的视频,背后有哪些玄机呢,Google 最近发布了“Fused Video Stabilization”技术的文档,来揭露其中的细节。

首先,在 Google 看来,影响手机录制视频的问题主要有这么几个,相机的抖动,运动状态下的画面模糊,快门失真(也就是当移动过快时画面扭曲)。

前两者都比较好理解,都是我们录制视频时移动手机或者走动时经常会发生的。而快门失真,简单来解释的话,是因为相机在拍摄的时候,每一帧都需要一定的时间,尤其是从上到下拍摄时,这种现象会更明显。

而如果相机移动的过快,当相机拍摄到被摄物体的底部时,上半部分可能就会出现错位的现象,或者会锐利度会出现间歇的变化,使画面扭曲。

这些问题,在新的“Fused Video Stabilization”技术下得以在一定程度上解决掉。

在录制视频时,OIS(光学防抖) 和 EIS(电子防抖)同时开启,初代 Pixel 上只用 EIS,这也是使得画面看起来僵硬不自然的一个原因。

OIS 的原理,是使用机械悬挂式相机,通过电磁铁的快速移动,来补偿或抵消拍摄中产生的震动;而 EIS 的作用则是在录制和播放视频时,牺牲掉部分帧来减少画面的抖动。

目前的 EIS 有很多种,不过其工作原理几乎是一样的,都是去编辑录制的每一帧来保证画面的稳定。

而在 Google Pixel 2 上的 EIS,则是通过来自陀螺仪和加速度计的硬件数据来增强视觉识别系统。

陀螺仪和 OIS 的数据将会被记录在每一帧中,而每一帧则会被存储到缓冲区中,然后交由一个叫做 lookahead filtering 的神经网络模组进行计算和优化,也就是说,这里面也用到了机器学习。

此外,Google 这一套全新的算法还包括了录制视频时对下一个可能的运动方向及画面的预测,还包括对原始运动数据以及相应的帧的整合运算,而对于每一个被记录的帧,设备都会重复这个过程,最后才能得到我们看到的结果。

以上这些还只是“Fused Video Stabilization”机制中的一部分,Google 公布了更多的技术细节,如果你感兴趣,可以前往阅读更多的内容。

Google Pixel 2 XL 已在路上(但愿,到手后会带来详细的评测。