用上自研芯片的 Pixel 6,能和 iPhone 13 正面刚吗?

这次 Google 可谓是抢了爆料人的「饭碗」。

在 OnLeaks 等爆料人发布 Pixel 6 的产品信息之后,Google 居然来了一波主动确认,公布了 Pixel 6 系列的详细外观、摄像头配置、自研芯片等,甚至直接在 Google Store 上架了 Pixel 6 页面。

这在对产品保密极为看重的手机行业并不多见,据 Vice 报道,前段时间苹果甚至还向爆料人发出信函,要求停止发布相关产品信息。

看似违背常理,其实是 Google 在为这台旗舰造势,以往 Pixel 虽然有自己的特色,但在整个手机市场中算不上主流,市场占有率也不高。

显然,这次自研芯片给了 Google 充分的信心,要与三星、苹果一争高下。

耗时四年,Google 造了一颗「AI」芯

Pixel 6 系列上的这个自研芯片传了几个月,现在终于尘埃落定,Google 将其命名为「 Tensor」。

比起几个月的爆料,这颗芯片的研发周期要来的久得多,Google CEO 达尔・皮蔡(Sundar Pichai)表示为了这颗芯片,它们耗费了 4 年多时间,有趣的是 4 年前也是 Google 收购 HTC 手机业务的时间。

HTC 曾经是 Google Nexus 系列手机的合作商,Google 显然是希望通过收购它,在手机领域一展宏图,如今到了开花结果的时候了。

▲ Google 与 HTC 合作推出的 Nexus One。 图片来自:Androidpolice

这次 Google 并没有公布人们比较关注的 CPU 和 GPU 性能方面的信息,而此前外媒 9to5Google 曾曝光称这颗自研芯片是 Google 和三星合作研发的, 性能方面很可能和三星的 Exynos 芯片接近。

具体还是要看今年秋天的真机表现。

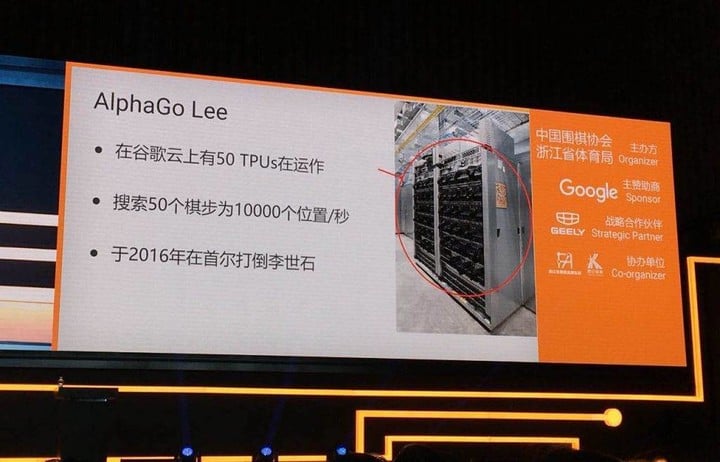

从 Google 一系列操作来看,Tensor 自研芯片的亮点很有可能并不在 CPU 或是 GPU,而是它的 TPU 单元(Tensor Processing Unit),芯片都用 TPU 来命名了,可见 Google 的重视程度。

▲正在运行的 TPU

TPU 原本是 Google 用于人工智能和机器学习的智能芯片,常配合 Google 自家的开源机器学习平台 TensorFlow 使用,TensorFlow 拥有丰富的训练工具、数据库等,两者以往多在云计算、企业服务等领域配合使用。

相比常见的 CPU 和 GPU,TPU 更多用于低精细度但量大的运算。其运算能力十分强大,AlphaGo 围棋机器人就使用了这一芯片,在 Google 相册中,单个 TPU 芯片每天能处理超过 1 亿张照片。

其计算性能可想而知,也因此 Google 将其应用在了自家的搜索、Google 街景等服务当中,以更快的速度提供给用户更准确的结果。

这次 TPU 被应用到了手机当中,Google 高级副总裁 Rick Osterloh 表示在 Tensor 的加持下,Pixel 可以运行「数据中心级」的人工智能(AI)模型,堪称一台移动 AI 计算机。

而且还是可以离线运行的,也就是说通过 Tensor 的运算改善手机体验,并不需要将数据上传的云端,Google 不会通过网络将你的私人照片上传的网络数据库中。

听起来像是工业应用产品被放到了移动设备当中,有「降维打击」那味了,不过说到底,算力再强还是要看落地应用。

Google 想拓展 AI 在手机上应用的深度和广度

不出意外,计算摄影仍然是 Pixel 6 系列上这颗自研芯片核心应用场景之一,遗憾的是 Google 并没有向公众放出真机拍摄图片,仅有 Gizmodo、The Verge 等少数媒体看到了应用实例。

为了充分展示 Tensor 芯片的能力,Google 设置了一个对照组,在开启和不开启的两种情况下,抓拍一位频繁活动的孩子。

未经过 Tensor 芯片处理的照片中孩子的脸部和手都比较模糊,而另一组对照组则清晰了不少。

▲ HDR+ 样张示例

之前的 Pixel 系列手机也展示过类似的能力,即 Google 赖以成名的 HDR+ 算法,在人们按下快门键的同时,手机后台其实会自动拍摄多张不同曝光程度的图片。

并将图片分割成多个细小的特征块,通过机器学习选择合适的特征块,并对其进行变换,打个可能不那么恰当的比喻,就像是为图片加一层滤镜。

在这个过程中 Google 的人脸识别算法也会发挥作用,帮助手机快速识别到人脸,选择合适的特征块,最终多张照片合成一张清晰且自然的图片。

▲ Pixel 6 Pro 用上了后置三摄

而且这次 Pixel 6 系列带来了后置三摄设计,包括一个广角镜头、超广角镜头和一个支持 4 倍光学变焦的长焦镜头。

更多的镜头组合能让手机拍摄时捕获更多的信息,作为对照组,通过机器学习找出更合适的细节,最终输出一张暗部细节更清晰、高光锐利,更讨好人眼的高质量图片。

听起来是不是像图片后期处理的过程,计算摄影正是为了简化摄影过程,让更多普通人也能以简单的方式拍出清晰讨好眼球的照片。

![]()

▲ 图片来自:Counterpoint

而这只是 Tensor 芯片的牛刀小试,Google 高级副总裁 Rick Osterloh 表示他们已经将 HDR 算法应用到了视频拍摄领域。

在整个拍摄过程中,手机能实时调整白平衡参数,并且快速捕捉到太阳等元素进行拍摄优化,让视频更清晰自然。

这显然对手机算力提出了更高要求,可见 Tensor 芯片的 TPU 单元算力是多么给力。

在视频方面 Google 同样设置了对照组,Pixel 5、Pixel 6 和 iPhone 12 Pro Max 拍摄同一视频,视频分辨率和帧率分别为 4K 和 30Fps,结果包括 The Verge、Gizmodo 在内的媒体均认为 Pixle 6 表现最好。

作为 Google 口中的「移动 AI 计算机」,它的应用必然不止于计算摄影,在功能广度方面,Pixel 6 系列亦有突破。

Google 在翻译、语音识别领域已经推出了多项服务,这次通过 Tensor 它们来到了 Pixel 6 系列上,而且经过了不小的增强。

在 YouTube 等 Google 系软件服务上大多都有一个「实时翻译」功能,现在 Pixel 6 也能使用了,将不同的语音转换为英语。

语音识别同样也是加强的功能,通过语音你可以操控手机,比如 Google 的 Gboard 键盘可以根据你的语音输入短信内容,而且具备较为不错的识别速度和准确性。

同样的,这也会被用于 Google 的语音助手当中,让它更好的识别理解你的指令。

▲ Google Assistant 。图片来自:PC Mag

值得一提的是,现在这些功能均不需要通过网络,而是可以直接在本地运行,这依旧都有赖于 Tensor 的高算力,和对机器学习的深耕。

随着 Pixel 系列的不断发展,相信还会有更多的手机功能被改造优化。

离正式发布还有几个月时间,Google 就通过大规模的自曝引发了大量讨论,给看客们画了一个巨大的饼,同时也让真机表示更受期待。

异类,还是行业之光?

一直以来手机都被认为是一个硬件驱动的市场,更好的 Soc、更高素质的镜头、高清晰完整的屏幕等等促使人们升级换新,手机市场在新技术的浪潮下稳步前进。

Pixel 系列的出现给出了一份截然不同的答卷,软件成为了核心,甚至是驱动硬件升级的主要原因之一,这似乎更符合安迪-比尔定律。

2016 年 Google 发布初代 Pixel,赢过了同期的两大旗舰三星和 iPhone,也让人们意识到计算摄影的强大,它试图将拍摄成像这个物理问题变为一个可解决的数据问题。

在硬件短期内无法突破的情况下,计算摄影所代表的机器学习逐渐成为了的手机行业的新趋势,你能在越来越多手机厂商的功能、宣传中看到 AI 的身影。

苹果 2019 年推出了自家的计算摄影技术 Deep Fusion,最近华为在 P50 系列上也公布了相应的计算光学技术。

摄影之外的应用也有不少,华为和小米都推出了类似的「视频字幕」功能,自动识别手机播放的音频内容,自动翻译为中文字幕。

而对屏幕颇为关注的 OPPO 则带来了多个显示技术,包括增强画面清晰度的「视频超清增强」功能,增强色彩显示的 SDR 转 HDR 技术。

在其他手机厂商持续押注 AI 时,Google Pixel 虽然在持续前进,但前进的速度显然是慢了下来,最佳销量仍然是 2019 年的发布的 Pixel 4 系列,为年销量 720 万台。

从 Pixel 6 系列硬件大升级中可以看出 Google 的野心,其高级副总裁 Rick Osterloh 也表示要投入远超以往费用为 Pixel 6 系列营销。

根据以往的经验,人们对于高端旗舰的期望除了单项突出,更希望它是一个各项均衡,都能做到标杆级的产品。

Google 这次要与苹果正面竞争,进入高端市场,除了摄影方面做出特色,屏幕、续航等同样不可以拖后腿,而作为一款「AI」手机,能否在显示等关键功能中做出差异性,也是它是否能成功的重要影响因素。

而 Pixel 系列一旦成功,也会给其他厂商作为参考,引导行业加大对软件的投入,最终提升我们手中手机的体验。