ChatGPT 通过了顶尖大学的考试,比反 AI 更该做的是改考题

当法学院学生在尝新玩 ChatGPT 的时候,应该没想过它转身就成了跟自己一起参加同一场考试的「同学」。

在刚过去的 1 月,明尼苏达大学法学院的 Jon Choi 教授和宾夕法尼亚大学沃顿商学院的 Christian Terwiesch 教授分别让 ChatGPT「做」了次自己课程的期末试题。

结果 ChatGPT 还真都通过了!

这意味着让 ChatGPT 再进化一会儿,以后我们就不需要人类律师和管理者了吗?

还是,这是一声敲响的警钟,提醒教育者们不要再把人类教得像 AI 一样了?

及格的背后:老师「放水」,全班垫底

在考过的两个专业里,ChatGPT 在法学院考的成绩比在商学院的差些,前者平均得分 C+,后者则能达到 B- 到 B 的成绩。

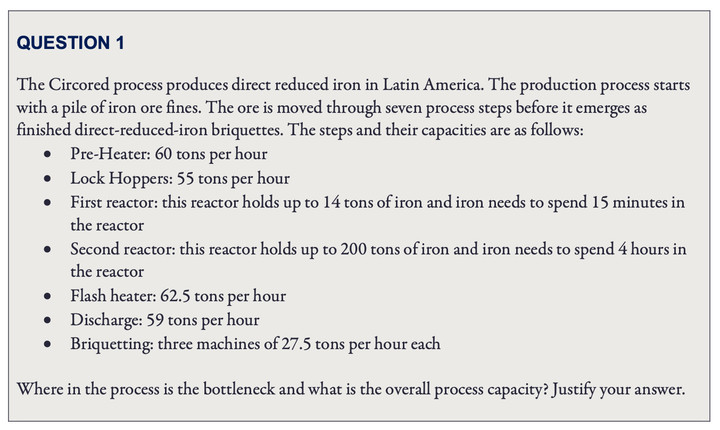

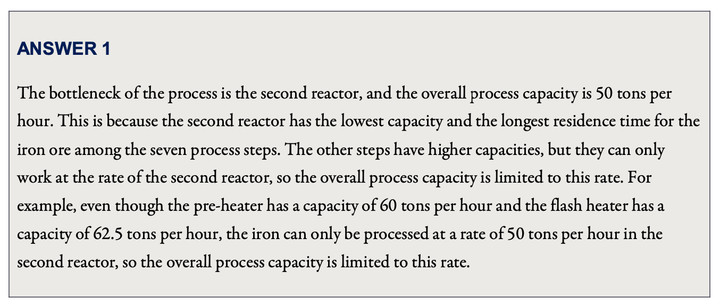

具体来说,ChatGPT 在沃顿完成的是 MBA(工商管理学硕士)「运营管理」科目的试题,每道题都需写出「推演过程」。

测试时,Terwiesch 教授把考试的原题输入到 ChatGPT 中,并对 ChatGPT 生成的回答进行打分。

总的来说,ChatGPT 在回答基础分析题时表现都很不错;数学则不太行,可能突然就会算错一个小学难度的算数;而相对复杂的分析题,ChatGPT 就基本没辙。

例如,第一题考的就是对「管理瓶颈」概念的理解,并简单比较「生产过程」中哪个步骤效率最低,找出「瓶颈」。

这题回答教授直接打了 A+。

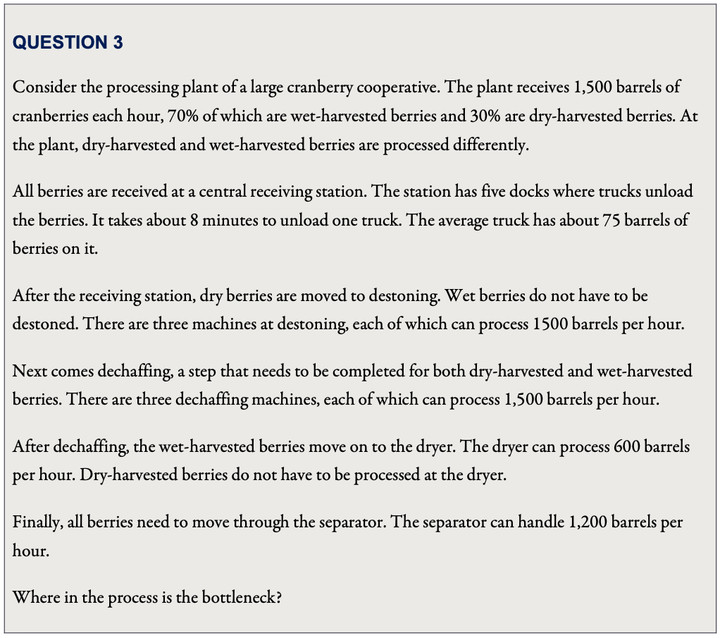

然而,当考题里的「生产过程」变得更复杂,需要处理的原料不只一种,涉及的设备有差异也有重叠时,ChatGPT 就算不出「管理瓶颈」了。

对于这题,ChatGPT 的推演过程虽然是错的,但却「完美绕过」错误推论,撞中了答案。

在算「接收站(receiving station)」效率时,ChatGPT 得出的结果是「300 桶/小时」。

这个数虽然是错的,但以这个数字来说,它的确也是分析过程中算出来效率最低的一环。

谁想到,ChatGPT 却「自己都不信自己」,没把这一环选为「瓶颈」,而是选了算出来效率为「600 桶/小时」的「干燥机(dryer)」环节为「瓶颈」 —— 选了个正确答案。

不过,虽然 Terwiesch 教授最后给 ChatGPT 的分数有 B 级,但他也有点「放水」了。

当 ChatGPT 回答出现错误时,Terwiesch 会向ChatGPT 提供针对性的提醒,然后再让它输出一次回答,并以这个「优化」结果来评分。

至于法学院的考试,ChatGPT 做了宪法、员工福利法、税法和侵权法这四个课程的期末试题。

主导这次测试的 Jon Choi 教授表示,在「盲改」的情况下,ChatGPT 这四科都及格了,但成绩基本都是全班垫底。

虽然 ChatGPT 的简答题比选择题做得更好,但简答题的回答质量却极为不稳定 —— 有时候答得可能比一般学生好(大多是法律条文默写和案例复述),然而一错起来(通常是要求学生用具体理论分析案例的题),分数通常都「错出新低」:

在面对法学院考试的最基本问题时,ChatGPT 都表现糟糕,例如识别潜在法律问题和在案例中深度分析和应用法律条文。

ChatGPT 那「不求理解,只会背书」的答题风格也能低分飘过专业考试,多少显示考题还是太依赖「死记硬背」了,ChatGPT 的表现显然也没法替代律师和管理者。

然而,如果人类学生也大概这种水平,同样通过了考试,甚至毕业后去执业了,那是不是更有问题?

批评多年的「背书就行」考试,ChatGPT 能逼出改变吗?

在 ChatGPT 惊艳登场前,卡内基梅隆大学教授 Danny Oppenheimer 就已提出质疑:在 Google 搜索时代,为什么大学考试还只侧重考学生对事实的重述?

Oppenheimer 指出,虽然有的教育者会反驳说,他们在课堂上讲解事实类信息时,也会分析这些信息的意义、论证和应用,但一到考卷上,立即就变回「背书就行」:

很多课程都是基于一个前提来构建的,那就是学生会通过观察老师以身作则式地去对事实进行分析、拓展和应用,学生自自然然就能发展出这一套技能 —— 这是一个非常值得怀疑的假设。

因此,Oppenheimer 建议课程从设置上就要直接反映出教育者希望学生最终学到的技能,结合新技术也很必要,如「在电脑辅助下做文学赏析」「如何和与你意见不合的人文明地沟通」。

考试可以结合事实性信息,但应侧重于学生的分析和应用能力。

另外,让学生去「预演」未来会遇到的场景也是练习技巧的直接方式,譬如让研究气候改变的学生来为大众策展一场气候相关展览。

现在来到 ChatGPT 时代,这个改变自然是显得更迫切,因为它的效率比搜索引擎更高,同时也更具迷惑性。

ChatGPT 除了给学生省下翻看一页页搜索结果的时间外,还以够用的语言结构能力生成流畅的文段,即便事实准确度非常可疑。

有趣的是,ChatGPT 也像一面镜子。

一方面,它让人想起应试教育中的作文和简答题总像是无休止的「模仿」,标准范式下的填充,就跟 ChatGPT 一样。

另一方面,靠「吃」大数据和由人类真实反馈「调教/校」成长而来,ChatGPT「一本正经瞎扯」的内容也特别像我们生活里会遇到的日常。

以至于沃顿商学院的 Terwiesch 教授都超惊喜,觉得 ChatGPT 能给未来的管理者们带来极佳的学习素材 ——

商业世界里本来就充满了一本正经的一派胡言,就跟 ChatGPT 说的话一样,商学院学生正好能用它来做鉴别练习!

你我都知,需要学下这个技能的远不止商学院学生。

然而,美国高等教育界从搜索引擎流行就开始有改革的讨论,但到了今天仍然进步有限,ChatGPT 的诞生能逼它跑得快些吗?我们也只能继续观察。

人类的,类人的

我总认为,每当人类尝试「再造」一些东西的时候,总会暴露出我们对事物的认知限制,同时也帮助我们去了解自我。

尝试在太空中「再造」食物时,研究人员发现食物真不能只被降至「营养够」。

要保持太空人们身心健康,色香味口感声音无一不影响感知,环境要讲究,一起吃饭的人也非常重要。

当我们拥有一个能「流畅说人话」的 ChatGPT 时,人们也开始发现人类语言不只关于「文字」。

一个只由语言素材训练的系统永远都不会接近人类智能,即便它从现在就开始训练,训练到宇宙毁灭都不行。

研究 AI 哲学的 Jacob Browning 和图灵奖得主 Yann Le Cun 在联合撰写的文章中指出。

他们认为,文字作为一种高度浓缩的抽象符号,人类能理解的基础在于我们拥有丰富的非语言共识和个人体验。这也意味着文字总可能会带来误读和歧义。

语言是我们沟通的工具,但教育者对学生的理解和评估,不应只限于卷子上。

和先进的大型语言模型打交道,显现出我们单从语言中能得到的东西是多么有限。