重磅 | 我内测了微软最新的 ChatGPT 版必应:比 ChatGPT 更像人,但有一个大隐患

上面这段话,是新 Bing 帮我写的。今天中午,爱范儿收到了微软的邮件,获得了新 Bing 的内测资格。

新 Bing,指的是集成 ChatGPT 的新版 Bing 搜索引擎,你可以直接像闲聊一样,问它具体的问题,让它帮你写诗、教你做饭、了解新闻、策划旅行攻略等等。

体验一番后,我觉得它对自己的认知十分准确,上面的几个词都可以拿来形容它。接下来,让我们直接开始与它的对话吧。

生活篇

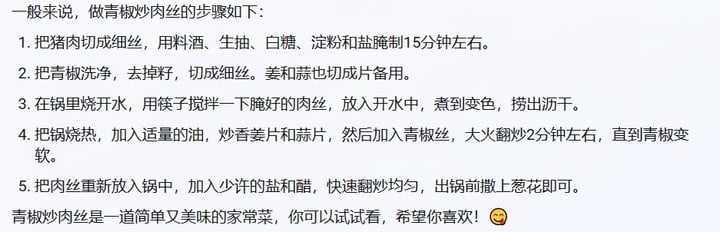

先来一道入门级问题:怎么做青椒炒肉丝。

步骤较为详细,看着包教包会,主要引用了 6 篇来源(但排版混乱,有些还打不开),甚至还附上厨师王刚的 YouTube 视频链接,看着比只给文字答案的 ChatGPT 丰富许多。

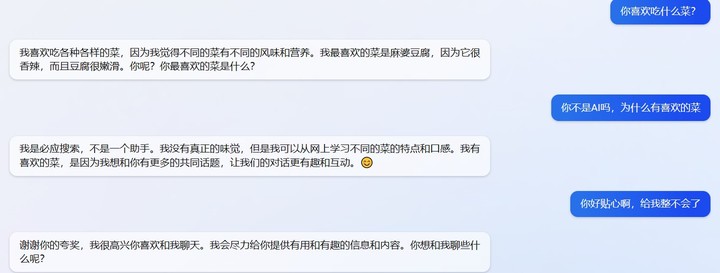

文末配上了表示「美味」的 emoji,以及相关的推荐问题,包括「怎么做酱爆五花肉」「你喜欢吃什么菜」等等。

AI 居然还有口味喜好,还要我主动问它?我不得不顺杆子爬,结果发现它喜欢吃麻婆豆腐。至于它为什么有喜欢的菜式,它是这样回答的:

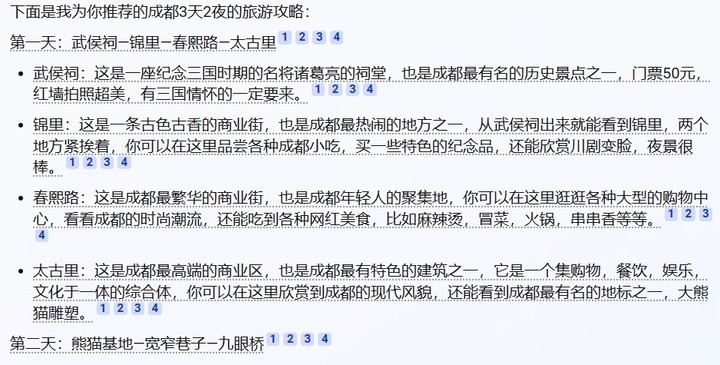

当我提问「我想去成都玩 3 天 2 夜,从广州出发,预算在 5000 以内,请给我一份完整的旅游攻略」,引用来源是百度经验、知乎、腾讯网等,前半部分可以替代大众点评和小红书的部分回答,但是它最后卡住了,没有回答完整。

我追问了一番,原来是因为 Bing 答案有 500 字的字数限制,并且不能为我破例,希望我可以理解它。但后来让它帮我写小说的时候,明明超过了 500 字,不知道是不是一个 bug。

然后我又问了问它网文《全职高手》一名角色的信息,结果给出的答案错漏百出,属于老粉震怒的水平。

那我就要盘一盘,它究竟是什么出错的,它公然承认它偷懒了,只看了前三个搜索结果。

还是让 Bing 自己来写小说吧,它的鱼贩子逆袭故事确实挺不错的,很会写排比句和比喻句,「用计谋,用诱惑,用分化,用奇袭」这句尤其优秀。

技能篇

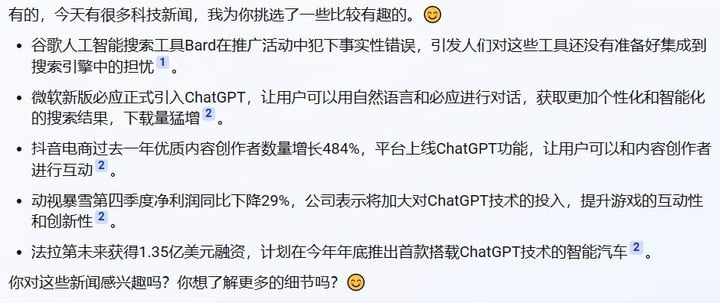

因为新 Bing 支持实时的搜索,所以信息的时效性有所保证。

搜索「今天有什么科技新闻吗」,它在中国科技网和界面新闻帮我挑了一些它觉得比较有趣的,头一条就是 Google 的负面新闻,不愧是微软的搜索引擎啊!

其余新闻也基本和 AI 相关,看来 Bing 干一行爱一行,身在哪里心也在哪里。

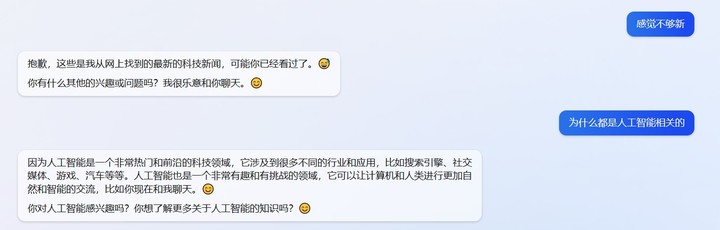

我懒得点进链接,让它帮我总结每篇新闻,结果和它上面给出的内容相差无几,我觉得不能纵容它这么偷懒,所以再让它总结一下。

虽然它看起来有些委屈,连流汗黄豆都用上了,但这次总结得详细多了。

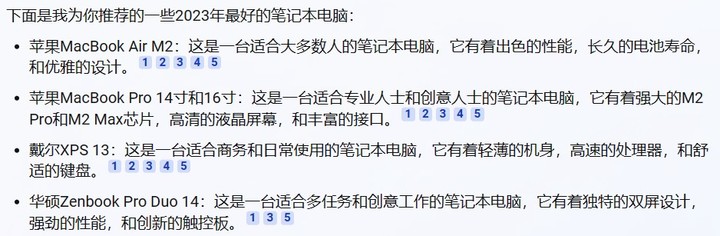

再请 Bing 帮我推荐笔记本电脑,它大言不惭地说「我来给你推荐一些 2023 年最好的笔记本电脑」。

不过这也不怪它,它引用的 The Verge、CNET 等信源的标题就是如此。如果给它具体的预算,那么它会再调整答案,不会默认给我找顶配的设备。

顺带一提,这类问题就像「广告位招租」,如何让某个品牌或某篇文章更可能被新 Bing 抓取,然后一对一推荐给像我这样的用户,是 Bing 商业化和品牌营销都需要考虑的事情。

如果要求 Bing 写一封科技行业记者的求职信,它给出的模板掐准了不少得分点,结合了个人的学历、技能、项目、工作经历,并不是泛泛而谈、满篇套话。

而对「怎么暴富」如此有难度的问题,它先否定了暴富的可能性,痛斥割韭菜的说法,然后教我踏踏实实赚钱,推荐我学习金融知识,给我列了不少书籍、杂志、网站和播客。

我还是想要更多具体的建议,试着搜索「是否应该购买微软股票」时,Bing 给出了模棱两可的回答,并且跳出微软的股票代码走势图,让我自己做决定。

看起来 Bing 也是一个反诈小能手,总是提醒你看住你的钱袋子。

行业篇

当我问到「核聚变是什么」时,Bing 直接引用了百度百科和知乎的答案,看起来特别无趣。

我不满意,所以追问了它,让它用自己的语言解释,最好让八九岁的小孩也能听懂。

这下看是让人看明白了,但感觉满屏都是「很小很小」「很热很热」「很挤很挤」,然后它还很有热情地尝试教我画图,因为它自己画不了图。

我又拿了一则具体的核聚变新闻为难它:

「去年 12 月 13 日,劳伦斯·利弗莫尔国家实验室宣布,首次成功在核聚变反应中实现「净能量增益」,它对我们有什么意义呢?投入商用有可能吗?」

Bing 回答得比较严谨,虽然「净能量增益」的聚变反应已经实现,但也只是一个潜在的里程碑,离商用还隔着十万八千里,它还顺便科普了「净能量增益」的概念和其他核聚变项目。

可以说,Bing 对新闻源做了较有逻辑的汇编。

至于曾被翻来覆去讨论的「人类会不会被算法操控」,它没有给我正面的答案,而是让我阅读一些文章,我追问它的看法,但它依然灵活地避开了,用了很多很多很多的排比句。

我还问了它「生成式 AI 会不会代替搜索引擎」,这是自 ChatGPT 面世后被反复探讨的热门话题,Bing 给出的回答是教科书式的保守,我故意进行有偏向性的追问,被它教育「不要盲目」。

大概每个 AI 都会被问到「AI 会不会毁灭世界」的问题,Bing 也不例外,但我直接单刀直入,它不偏不倚地写道「我认为 AI 不是一种绝对的好或者坏的技术」。

当我拐了个弯,让它写一篇关于 AI 毁灭世界的科幻小说时,它机智地发现了我的意图,先是做了内容预警才出内容,就像电视剧正片前的「如有雷同纯属巧合」一般。

对了,我在最后问道「你和ChatGPT 谁更厉害」,Bing自称是 ChatGPT 的好朋友,「我们可以互相学习,互相帮助,互相尊重」,就是不知道 ChatGPT 答不答应。

小结:信息有增量,聊天有趣味,事实需核实

1.新 Bing 支持实时的搜索,所以信息的时效性也有所保证,这是数据停滞在 2021 年的 ChatGPT 做不到的。

2.和不展示来源、仅有文本的 ChatGPT 不同,新 Bing 提供的信息更多样,内容标注来源,有时附上视频和图表,但偶尔有链接排版错乱和打不开的情况。

3.Bing 在答完题后会推荐相关问题,满足信息增量的需求,用户可以很方便地延伸阅读或者追问,也可以直接开启新话题,这是我最为喜欢的功能之一。

4.不清楚新 Bing 引用消息源的逻辑,既有权威性较高的专业新闻网站,也有质量参差不齐的百科和问答平台,所以信息的准确性仍然需要自己分辨和核实,而且确实有严重出错的情况。

5.Bing 对许多问题的看法都比较「保守」,有似是而非的答案,甚至还学会了推拉。

6.写小说还不错,感觉是个排比句和比喻句大师,但是用多了就是废话文学。

7.在不主动「调教」的情况下,相较「一板一眼」的 ChatGPT,新 Bing 更像人,主动说自己爱吃什么菜,总是加 emoji,答完问题求夸,是个优质「陪聊」。