英伟达 AI 的 iPhone 时刻来了

在 3 月份的 GTC 大会上,英伟达 CEO 黄仁勋抛表示,「AI 的 iPhone 时刻已经到了。」

时隔 5 个月后,黄仁勋这句话或许可以改写为「英伟达 AI 的 iPhone 时刻已经到了。」

今天,英伟达公布了 2024 财年第二财季财报。第二季度营收为 135.1 亿美元,同比增长 101%,环比增长 88%。此外净利润 61.88 亿美元, 同比暴增 843%

值得注意的是,这也是英伟达首次在季度收入上超过英特尔,迎来了一个历史性时刻。

创纪录的英伟达,狂飙的新计算时代

财报公布后,英伟达股价盘后交易飙升 9.6%,股价再创新高,突破 500 美元,成为美股市场里「最靓的仔」。

英伟达对下一个财季也做出了颇具野心的展望,收入预计达到 160 亿美元,上下浮动 2%。而这数字几乎是一年前水平的 3 倍,比分析师平均预期的 123 亿美元还要高出 37 亿美元。

在财报中,黄仁勋表示:「一个新的计算时代已经开始,全球各地的公司正在从通用计算向加速计算和生成式 AI 转型。」

芯片依旧是英伟达的收入支柱,其向数据中心供应芯片的部门是公司最大的收入来源,该部门第二财季营收达到 103.2 亿美元,增长 171%,远高于市场预期的 79.8 亿美元。

其中 H100 是市场上最抢手的芯片,一度被炒到超过 4 万美元(约 29 万元人民币)。

此前消息人士向投资银行公司的 Raymond James 透露,H100 GPU 的成本为 3320 美元(约和 24181 元人民币),而英伟达选择以 25000 至 30000 美元(当前约 18.2 万至 21.9 万元人民币)的价格出售这些 GPU。

虽然这一说法可能没有考虑到运输物流等其他成本,不过仅从生产成本 / 售价的比例来看,英伟达 H100 GPU 简直就是一个「超级摇钱树」。

据 Tomshardware 报道,英伟达今年内计划出售超过 55 万块 H100 GPU。倘若属实,这意味着英伟达光从 H100 GPU 中获得的收益就已经是个天文数字。

不过由于 H100 芯片需要先进的生产工艺和同样复杂的封装技术,供应量将直接和代工厂台积电的封装能力相关,也是 H100 缺货的重要原因,行业高管预计 H100 的短缺将持续到 2024 年。

黄仁勋表示,英伟达正在寻求与其生产合作伙伴合作,将更多芯片推向市场,包括通过与其他公司合作来补充台积电的封装能力,并表示「今年剩余时间和明年的供应量将大幅增加。」

生成式 AI 的爆火,无数科技巨头争先抢后地躬身入局生成式 AI 赛道,试图打开这道充满机遇的科技大门。英伟达这个守在 金矿大门外卖「铲子」的人率先成为了赢家。

微软和 Google 这些巨头虽然已经在 AI 投入了上百亿美元,但目前基本还没转化为利润。至于风头正劲的 OpenAI,Analytics India Magazine 报道称其每日维护 ChatGPT 这一项服务就需花费 70 万,尽管一直试图通过 GPT-3.5 和 GPT-4 实现盈利,但目前的收益仍未能实现收支平衡。

▲ OpenAI CEO Sam Altman 图片来自:CNN

然而,如果 OpenAI 无法扭转局面,面对每日高额的成本及其无法快速实现盈利的情况,Analytics India Magazine 认为 OpenAI 甚至可能在不久将来就要宣布破产。

对英伟达而言,在 AI 芯片这个赛道中目前还没有哪家科技公司能望其项背。

研究公司 Omdia 的数据显示,虽然 Google 、亚马逊、Meta、IBM 等公司也在生产 AI 芯片,但英伟达已占据了超过 70% AI 芯片销售额,并且在训练生成式 AI 模型方面有着更显著的优势。

Futurum Group 分析师 Daniel Newman 表示,很多客户宁愿等待 18 个月向英伟达采购芯片,也不从初创公司或其他竞争对手那里购买现成的芯片。即便是十多年前就开始布局 AI 芯片的 Google,有些工作也不得不依赖英伟达的 GPU 来完成。

尽管芯片的价格高昂且缺货,但反而英伟达芯片可能是目前世界上成本最低的解决方案。黄仁勋表示高性能芯片其实为客户节约了更多资金。

如果能够将价值 50 亿美元的数据中心的训练时间减少一半,所节省的费用将超过所有芯片的成本。

算力、模型、数据一直是 AI 发展的三大要素,AI 芯片所代表的算力既是人工智能的底层基石,也是打开这道科技大门的钥匙。

这把通往未来的钥匙正掌握在英伟达的手中,并形成了自己的护城河。

英伟达的芯片护城河

58 年前,英特尔创始人之一戈登• 摩尔提出了著名的摩尔定律。

集成电路上可容纳的晶体管数目,约每隔两年便会增加一倍。

随后新的推断又涌现了出来,两年的时间间隔被缩短到了 18 个月。

在摩尔定律的作用下,CPU 和 GPU 的处理性能都获得了指数级的增长,2000 年以后,CPU 从单核走向多核,核心数量得到大幅提升。

AI 深度学习的训练和推理大量依赖矩阵计算和浮点计算,对算力提出了极高的要求,而 GPU 能够大规模并行计算,在矩阵和向量计算上远超 CPU,成为高性能计算的「宠儿」。

此外,高速的内存宽带、可扩展性强的算力池、专门优化的深度学习框架、云端部署支撑等优点,也坚定确立了 GPU 在 AI 时代的算力核心地位。

成立于 1993 年 4 月的英伟达最初便是靠 GPU 起家,通过不断的创新和发展,逐渐成为了高性能计算领域的领导者。

根据 Jon Peddie Research 发布的 GPU 市场数据统计报告,英伟达以 84% 的市场份额排名第一,排名第二的 AMD 为 12%,第三位的英特尔为 4%。

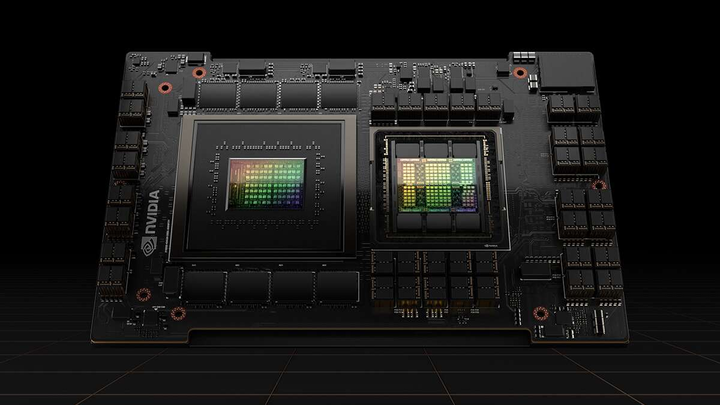

A100 和 H100 都是英伟达专门为 AI 计算设计的顶级数据中心 GPU,在训练和推理大型神经网络方面,性能都远超其他竞争对手,二者也都采用专门的 Tensor Core 和数据流架构,堪称英伟达手里的两张王牌芯片。

今年以来,英伟达主打的就是「你买的越多,省的也越多」,非常熟练且「贴心」地推出各种迭代更新的 GPU。

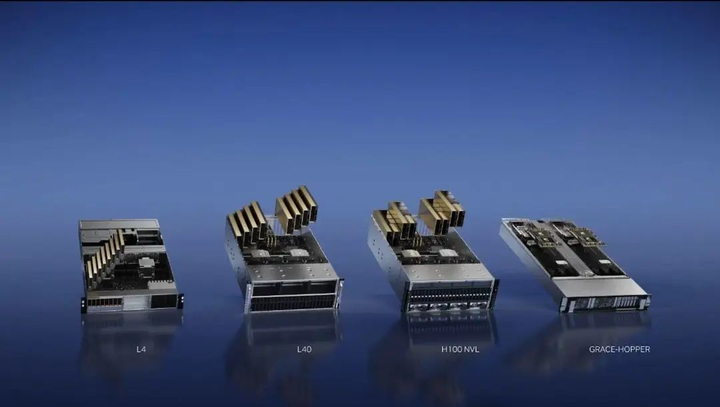

3 月,英伟达一口气发布了 H100 NVL GPU、L4 Tensor Core GPU、L40 GPU 以和 NVIDIA Grace Hopper 四款 AI 推理芯片。

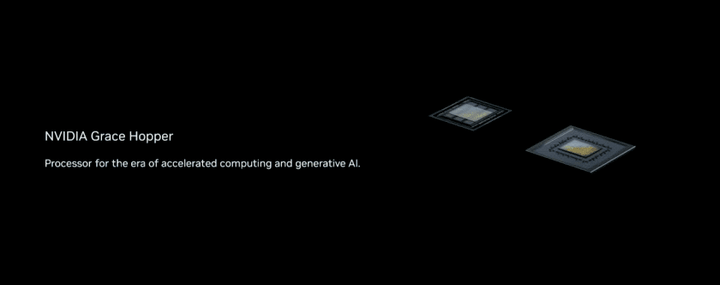

两个月后,5 月的台北电脑展上,黄仁勋发布了用 256个 NVIDIA GH200 Grace Hopper 超级芯片组成的超级计算机 DGX GH200。

就在两周前,黄仁勋又发布了搭载 HBM3e 内存新版 GH200 Grace Hopper,这也是世界上首个搭载 HBM3e 内存的 GPU 芯片。

HBM3e 内存是一种新型的高带宽内存技术,在运算速度上 HBM3e 能比 HBM3 运算速度快 50%,提供最高 5TB/秒的传输速率。

训练和推理是 AI 大模型的非常重要的两个步骤,而这恰恰是 GH200 所擅长的部分。在黄仁勋看来,未来 GH200 的典型应用场景就是大语言模型,并且「加速运算」、「AI 运算」将逐渐取代传统 x86 GPU的「通用计算」。

过往无数的案例证明,优异生态系统一旦构筑成护城河,外来者在竞争中便占了下风。

英伟达过硬的生态系统自然少不了竞争对手的盖章认证,神经网络科学家 Naveen Rao 曾在英特尔担任过副总裁与人工智能平台事业部总经理。

他发现英伟达的最大优势不仅仅在于芯片本身,而是英伟达拥有一个具有大量优秀人工智能程序员的大型社区和集散地。

每个人都优先以英伟达为基础,当你推出了一款新硬件,就会全力追赶它。

在第二财季财报中,黄仁勋也谈到:「通过我们的 Mellanox 网络和交换机技术连接并运行我们的 CUDA AI 软件堆栈的英伟达 GPU 构成了生成式 AI 的计算基础设施。」

CUDA 是英伟达基于其生产的 GPUs 的一个并行计算平台和编程模型,目的是便于更多的技术人员参与开发。

开发人员可以通过 C/C++、Fortan 等高级语言来调用 CUDA 的 API,来进行并行编程,并进行高性能计算,这种生态系统的建立使得许多开发者依赖于 CUDA。

此前,黄仁勋向外界透露,CUDA 在全球已经拥有超过 400 万开发者和超过 3000 个应用程序,CUDA 下载量累计达到 4000 万次,全球 有40000 家大型企业正在使用英伟达的产品进行加速计算,已有 15000 家初创公司建立在英伟达的平台上。

庞大的数字折射出英伟达显著的先发优势,倘若其他对手想要推出新的硬件,则还需要考虑追赶这个已经形成的人工智能创新生态系统。

交易的两端,一端连着卖方,一端连着买方。

4 月份,「双标」的马斯克一边联名签署禁止训练 AI,一边偷偷扫货 1 万张 GPU 来开发大模型,甚至还不忘在 X 上公开吐槽:「似乎每个人、每条狗都在购买GPU」。

上个月,甲骨文董事长在公开场合表示,甲骨文公司将斥资数十亿美元购买英伟达的 GPU,以扩大针对新一波人工智能公司的云计算服务。

得算力者得天下,在你追我赶的生成式 AI 赛道上,国内也同样蔓延着求「芯」若渴的焦虑。

在财报电话会议上,英伟达 CFO Colette Kress 称:「我们预计,连续增长将主要由数据中心驱动,其中对中国客户的销售约占英伟达最新季度数据中心收入的 20%至 25%。」

此前,据英国《金融时报》报道,中国互联网巨头正争相抢英伟达高性能 AI 芯片,今明两年的订单价值高达 50 亿美元。

其中百度、腾讯、阿里巴巴以及字节跳动今年向英伟达下达的支付订单金额合计 10 亿美元,总共采购 10 万张 A800,相当于每张 A800 芯片的价格达到 1 万美元,明年再交付余下的 40 亿美元。

A800 本质上是 A100 的「阉割版」。由于去年 8 月份受到政策影响,英伟达只能面向中国大陆市场推出不受限制的替代版本。

不少行业人士认为,GPU 已经成为市场上公认的稀缺货,一芯难求的局面在未来的一两年内依旧难以缓解。

因此,在 GPU 供不应求的持续追捧下,英伟达的 GPU 甚至成为一些 AI 初创公司的硬通货。

作为一家云计算初创公司,CoreWeave 想要获得创业贷款并不是一件容易的事情。得益于英伟达的投资人身份,CoreWeave 甚至可以将 H100 GPU 作为抵押物,轻易获得了 23 亿美元的贷款。

在贷款方看来,这自然不会是一笔亏本的买卖。

一方面,这笔贷款能够让 CoreWeave 的计算规模和实力得到快速扩张,增强偿还贷款的能力,另一方面,英伟达明年将推出更多迭代的 GPU,凭借与英伟达密切的合作关系以及这笔高额度贷款,CoreWeave 还可以在抢购明年上市的 GH200 GPU 上夺得先机。

正如前面所提到,既然头部大厂在市场上都抢不到 GPU,那实力并不雄厚的 AI 初创公司的处境显然更加堪忧。

一些聪明的 AI 初创公司只能选择另辟蹊径,抱团取暖,投入英伟达的怀抱。

今年 6 月份,人工智能初创公司 Inflection AI 官宣,完成 13 亿美元的新一轮融资,值得注意的是,崭新的投资名单里首次出现英伟达的身影。

拿到融资后,Inflection 转头将从英伟达购买了 22000 个 H100 GPU,以打造一台先进的超级计算机,其中包括近 700 个Intel Xeon CPU的四节点机架服务器

Inflection AI 表示,将和合作伙伴 CoreWeave 以及英伟达一起,构建世界上最大的 AI 集群。

看似欢喜的强强联合更像是一种无奈的抉择,Inflection AI CEO Mustafa Suleyman 接受《纽约时报》的采访时表示:「公司没有义务使用英伟达的产品,但竞争对手没有提供可行的替代方案。」

今年是英伟达的「而立之年」,在五月的最后一天,英伟达成为全球第一家市值突破 1 万亿美元的芯片公司,这也是历史上第九家跻身万亿市值俱乐部的科技公司。

今年 6 月,身穿毕业服的黄仁勋受邀参加了中国台湾大学的毕业演讲,用过往的人生经验寄语毕业生。

无论是什么,像我们一样全力以赴地追求它,跑吧!不要慢慢走。

不论是为了食物而奔跑,或不被他人当做食物而奔跑。

你往往无法知道自己正处在哪一种情况,无论如何,都要保持奔跑。

历史的机遇稍纵即逝,GPU 的赛道可能又是一个是赢者通吃的赛道。

一直狂奔的黄仁勋抓住 AI 的机遇,让诞生于路边连锁餐厅的英伟达成功跻身于万亿美元俱乐部,成为这波 AI 浪潮的最大赢家,或许还将继续领跑下个时代。