「兔子蹦床」播放超 5 亿!这条全网最火 AI 视频,是人类爱被「骗」的结果

一段看起来像是夜视监控拍到的「兔子蹦床」视频,在 TikTok 上爆火,全网收获了有 5 亿次播放。

视频看上去像是某户人家的安防摄像头拍到的,灯光昏黄、画面模糊,但恰到好处地捕捉到几只兔子轮番起跳,活像在开夜间演出。

视频的标题写着:「刚查看了家庭监控,我想我们家后院来了几位特邀嘉宾!@Ring」 。

监控的模糊画质、几只看似在狂欢的兔子,这可爱又略带一丝真实感的画面迅速吸引了人们的眼球 。

在社交媒体平台 X 上坐拥百万粉丝的名人 @Greg 也评论说,「我从没意识到自己需要一群蹦床兔子,直到今天」。

然而,这份可爱是虚假的。视频中的兔子并非真实存在,有人发现,它是AI生成的。

第 5 到第 6 秒之间,左上角的兔子忽然「消失」。回头再看,细节确实有点怪。

但和大多数「AI 穿帮」视频不同,这次几乎没人第一时间认出来。哪怕是刷视频经验老到的年轻人,也直呼「完了,我居然被骗了」。

但这不是一场骗局,更像是一种小型社交媒体的灾难:不是「我们被骗了」,而是「我们居然愿意被骗」。

看似糊得刚刚好,其实「骗」得刚刚好

这段 AI 视频之所以能成功「欺骗」大众,很大程度上并非因为 AI 视频生成技术已经完美,而在于它「骗得刚刚好」。

它精准地利用了我们对监控视频的固有印象,也踩中了最能让我们放下戒备的那些流量密码。

模糊的夜视画质和静态背景,刚好遮住 AI 的弱点

我们习惯于认为夜晚监控录像就是模糊、黑暗且充满噪点的。这种先入为主的印象,完美掩护了 AI 视频的技术硬伤,例如在动作连贯性、阴影细节和背景动态上容易穿帮等问题。

所以当它以「夜晚监控录像」的方式出现时,画质本身的低清模糊反倒成了障眼法,帮它遮住了真实感缺口。

▲ 视频画质符合夜间监控特点,且背景是完全静止。

此外,尽管一些 AI 视频生成模型在处理前景主体方面已经相当出色,但背景的渲染往往会显得非常超现实。

而这段视频的背景是静止的,这又为 AI 规避了一个技术难题。

带「@Ring」的文案增强了来源可信度

视频发布者在标题中聪明地标记了家庭安防摄像头品牌「Ring」,一下子就让这视频的来源显得有理有据,让人感觉更真了。

▲ Ring 是家庭摄像头品牌

这个小细节营造出「这视频是别人家门铃拍到的」错觉,让人自动归类为「生活记录」而非「创作内容」。

「动物夜间搞事情」是互联网用户默认接受的 meme

无数次病毒式传播的视频,已经训练我们相信这个场景是真实的。猫晚上偷吃泡面、浣熊夜闯泳池、郊狼在蹦床玩耍,动物们总爱在人类不在时「犯规」一下。兔子蹦床这种事,怎么看都合理。

▲ 熊闯入游泳池

最重要的:它太可爱了!谁会去质疑这么温柔的一幕呢?当一段内容足够甜、足够轻,它就很容易让我们「选择相信」。

尽管视频中间,左上角的兔子突然消失,暴露了 AI 生成的本质。但对于绝大多数刷短视频,快速滑动的观众来说,这一瞬间的破绽极易被忽略。

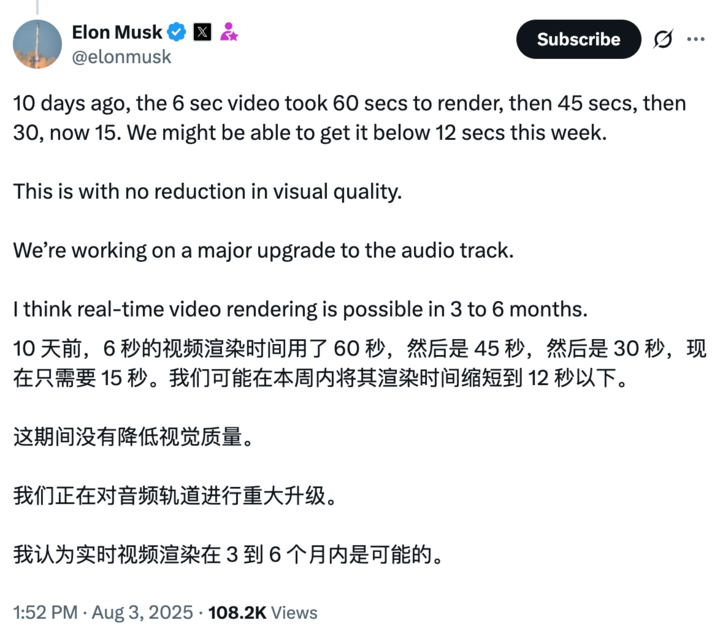

就在兔子视频引发热议的同时,马斯克也分享了 AI 视频技术的惊人进展。

10 天前,一段 6 秒的视频渲染需要 60 秒,之后降至 45 秒,再到 30 秒,现在已缩短至 15 秒。

本周我们或许能将时间控制在 12 秒以内。

他同时表示,实时视频渲染技术有望在 3 到 6 个月内实现。

▲ 马斯克推特截图

这意味着,今天我们还能看到的「兔子消失」这类穿帮镜头,在几个月后可能就几乎很难发现里面的 bug。

当 AI 视频在技术上无懈可击时,再去讨论「如何分辨真假」就失去了意义。

这也让我们不得不把目光从技术本身,转移到更核心的问题上。

让我们被骗和狂欢的,其实不是 AI

视频的真相揭晓后,许多用户表达了一种「信仰崩塌」的感觉。

一位 TikTok 用户说,「这是第一个我相信是真的 AI 视频,等我老了肯定完蛋了」。另一位用户则表示,「现在我觉得我以后就会是那种被骗的老年人」。

这种从自信到恐慌的情绪转变,成了一个新的网络热点。

然而,将问题仅仅归咎于「AI 发展得太快」或「我们太容易被骗」,可能忽略了更深层次的原因。这一事件的核心,或许不在于 AI 技术本身,其实在于社交媒体平台本身的那一套玩法。

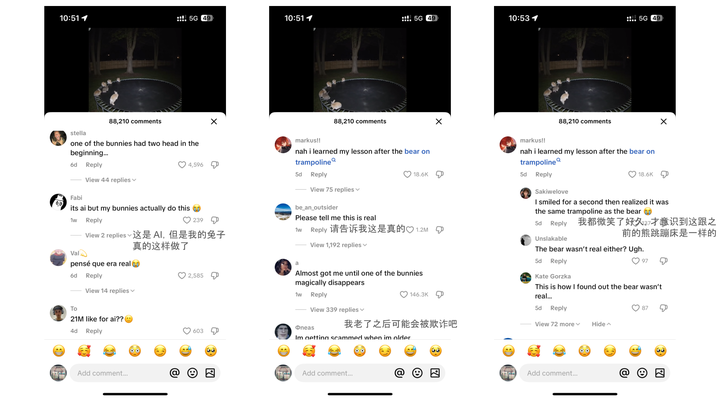

通过翻看视频的评论记录,我们发现人们在评论区的反应,呈现出来的几乎是同样的一个心理剧本。

首先是「天啊,这也太可爱了」;

然后,「等等,好像不太对劲?」;

第三步,「我被骗了?完了,我要变成会被骗的老年人了吗」;

最后还是回到了,「但……我不怪它」

我们正在和 AI 视频建立一种全新的「互动逻辑」。

我们不是完全相信它,而是默认它可能是假的,但我们依然愿意停下来看看、点个赞、转发给朋友猜一猜,就像一个游戏。

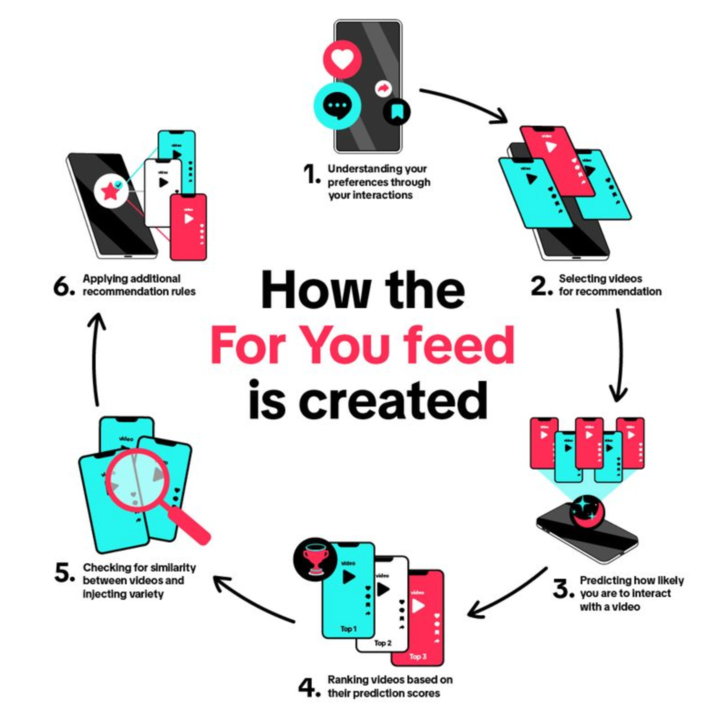

▲ 短视频平台推荐系统

而平台的算法,也深知这种心理结构。

在这个过程中,「AI 视频是真是假」不再是重点,它更像一种参与门槛:你看懂了没?你能分辨出来吗?你被骗了吗?

AI 爆发的这两年,我们总是感叹 AI 视频图片已经能以假乱真,因此感到恐慌,担心自己未来会更容易被虚假信息蒙蔽。

然而,这个视频的病毒式传播,并非完全源于 AI 技术的「欺骗性」,而是源于人类观众内心深处对「被欺骗」的需求。

这些网友不都是被动地被骗,而有不少是主动地、心照不宣地参与了一场名为「假装相信」的集体游戏。

这场狂欢的主角不是 AI,而是我们自己。

正是视频中那「一闪而过」的兔子消失 bug,才让整个事件升级为一场全网参与的「找茬游戏」。如果视频完美的天衣无缝,它可能只会然后迅速被下一个视频淹没。

▲ 电影「致命魔术」

这就像观众明知道魔术师在「欺骗」他们,但他们享受的恰恰是那种「明明知道是假的,却看不出破绽」的认知挑战。

AI 兔子的「穿帮」,就是这个魔术被揭穿的时刻,它让所有人加入讨论,从而引爆了传播。

缺陷创造了争议,争议驱动了参与。视频的真假不再重要,它所引发的混乱和讨论本身,就是流量的保证。

这种「我竟然也被骗了」的自嘲,迅速拉近了陌生网友间的心理距离,形成了一种「我们都是容易被骗的笨蛋」的社群认同感。由「共同被骗」而产生的连接,其社交价值远大于视频内容本身的真实性。

理想的情况是,我们学会有意识地享受这种「虚假内容」带来的乐趣,同时保持一份清醒的认知,但这可能对大多数人来说并不容易。

潜在的危险不只在于 AI 的逼真程度,而在于当这种「集体欺骗」被用于恶意时,比如制造谣言或骗局。我们需要建立的,是对信息「意图」的识别,而非仅仅对「真伪」的判断。

我们可以多问问自己:这个内容想让我产生什么感觉?它最终想让我做什么?