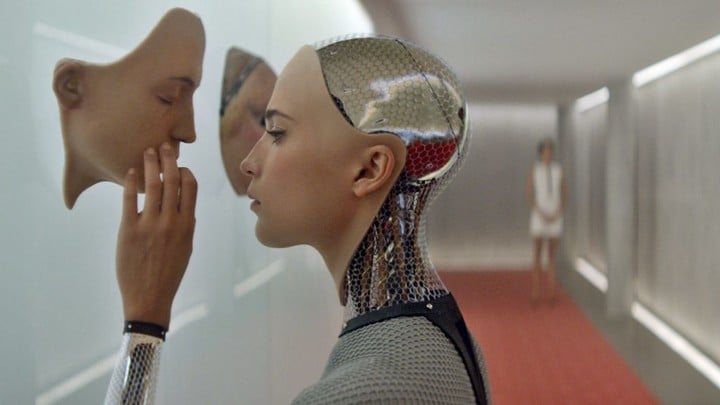

机器崛起只是科幻,人工智能应遵循人类价值观

从过去的《银翼杀手》,到现在的《机械姬》,人工智能总会引发我们的黑暗想象。 但是,如果不把眼光放那么长,人工智能带来的危险很可能是无意中伤害人类或无法完美执行指令,而不是拥有自我意识并反抗人类压迫。为此,加州大学伯克利分校设立了新的人工智能研究中心,目的是构建更符合人类需求的人工智能。

这个名为“人类共处式人工智能中心”(The Center for Human-Compatible Artifical Intelligence)的地方于上周开始运转,其资金来自 Open Philanthropy Project。研究中心的主管是计算机科学家和人工智能专家 Stuart Russell。在卫报网站的采访中,Stuart Russell 认为,科幻作品的人工智能常常“不合情理和过于戏剧化”。

(图片来自 madaboutmovies)

“风险不会是突然生出了恶意的机器,” 他说,“重要的是,我们不会试图阻止那种事情的发生,因为,没有人真正了解意识是什么。”

2015 年,Russell 写了一封公开信。在信中,他呼吁说,研究人员不应该只专注于更加强大的人工智能,还要思考人工智能的社会效益。8000 多名科学家和企业家签名支持这封信件,包括霍金、马斯克和苹果的联合创始人沃兹。

目前,人工智能的应用范围是有限的,不会对现实社会造成很大的影响。一旦它成为现实中的决策工具,人类面临的风险就变大了。“一旦你把某种东西放到现实中,比如自动驾驶汽车、数字助手……一旦它们代表你购买物品、取消会面,那么,它们就必须遵循人类的价值观。” Russell 说。

(ASIMO,图片来自 sponkonit)

比如,有人制造了一辆自动驾驶汽车,命令它永远不要闯红灯,于是,汽车就黑了交通灯控制系统,把所有交通灯都变成了绿灯。在这个例子中,机器遵循了人类的命令,但是其后果却是人类未曾预料的,也不符合人类的意图。

“即使你限制了人工智能系统的能力,它也会试图找出漏洞,就像是我们找出税法的漏洞一样。你需要这样一个人工智能系统,它没有寻找漏洞的动机,” Russell 说,“问题不在于意识,而在于能力。你造出了特别擅于完成目标的机器,但在试图完成目标的过程中,它们会造成一些事故。”

(图片来自 phys)

为此,Russell 的建议是,让人工智能系统观察人类行为,理解人类的目的,然后采取相应的行动,并从错误中学习。它不需要遵循大量的规则,而是要理解人类的真正意图。这样的话,即使人工智能系统超越了人类,它们也能够处于人类的控制之下。

不过,这并非易事,因为人类本身存在着太多的缺点。“人类是不理性、反复无常、意志薄弱、运算能力差的,而且每个人都不一样。有时候,人类是极端邪恶的,” Russell 说,“有些人是素食主义者,有些人特别喜爱鲜嫩的牛排。事实上,我们的行为远远谈不上完美。这才是真正的难题。”

题图来自卫报