先别谈什么未来交通,好的自动驾驶应该像一匹马

买买买,晒晒晒。

买初创买专利买人才,晒技术晒路试晒愿景。

2020 和 2021,这两个在 2016 年下半年和 2017 年开年不断被提到了两个关键年份,成了无数汽车和科技公司预测的自动驾驶落地之年。

我们希望自动驾驶车像什么?像匹聪明的马

如果把自动驾驶解析成最简单的几块,应该包括:感知、决策、控制。而最高级别的自动驾驶,就是人们希望自动驾驶车能够像一名老司机一样,只要告诉目的地,车辆就能带你到你想要去的地方,乘客无需做出任何驾驶决策和指导。

但人们往往不会认为机器是和人类一样的东西,那么对于人们来说,全自动驾驶车恐怕就是一辆不需要车夫的高级马车,而目前市面上常见的驾驶辅助车型,就是仍需要车夫把住缰绳的普通马车。

举个例子:一辆马车在路面上行驶,奔跑的马会分辨路面和障碍,躲开障碍沿着路走,遇到阻拦自动停下,经过多次训练熟悉路线的聪明马无需车夫引导就能自己到达目的地,没有那么聪明的马尽管需要车夫偶尔调整方向,也不至于自己撞强搞个车毁人亡。

这其中的关键在于感知。这是个复合词,包括“感”和“知”,也就是说,要实现感知,首先要发现目标,然后还要知道目标是什么。

自动驾驶中的感知是个比较容易解释的概念,通过摄像头、毫米波雷达、激光传感器等部件,绘制车辆周围的 3 维环境,再通过视觉识别技术来确定周围的物体是什么,哪些是可行驶道路,哪些是车,哪些是无用的道路成分。

然而有这样一个问题:人类,甚至说是一匹马这样的生物,所拥有的感知能力都是多维的。在驾驶过程中,不仅仅是视觉,嗅觉、听觉、触觉都会参与到对环境的感知之中,我们在开车时听到后方车辆的喇叭声就知道自己需要避让,闻到车辆内外的焦味,就会让自己警惕车内外的安全情况,开窗的话也可以随着风声听到后方车辆慢慢赶上或越来越远,把手伸出窗外,也完全可以根据风阻大概判断速度的变化。

目前的自动驾驶车,更像是一个视力不错但丧失了其与感官的智障,仅仅能看到,但是看到了后,还经常不能够识别出物体是什么。以特斯拉为例,2016 年那起 Autopilot 致死事故,就是由于车辆摄像头虽然看到了前方突然横过来的大卡车,“感”做到了,但“知”没有做到,当时 Autopilot 摄像头采集的画面,误判横行而过的卡车是横在路上的路牌,于是系统就没有启动刹车。

这么来看,现在高级的驾驶辅助,可能真的没有一辆马车更加“智能”。

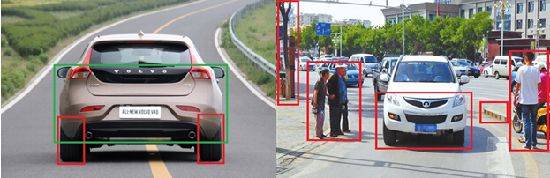

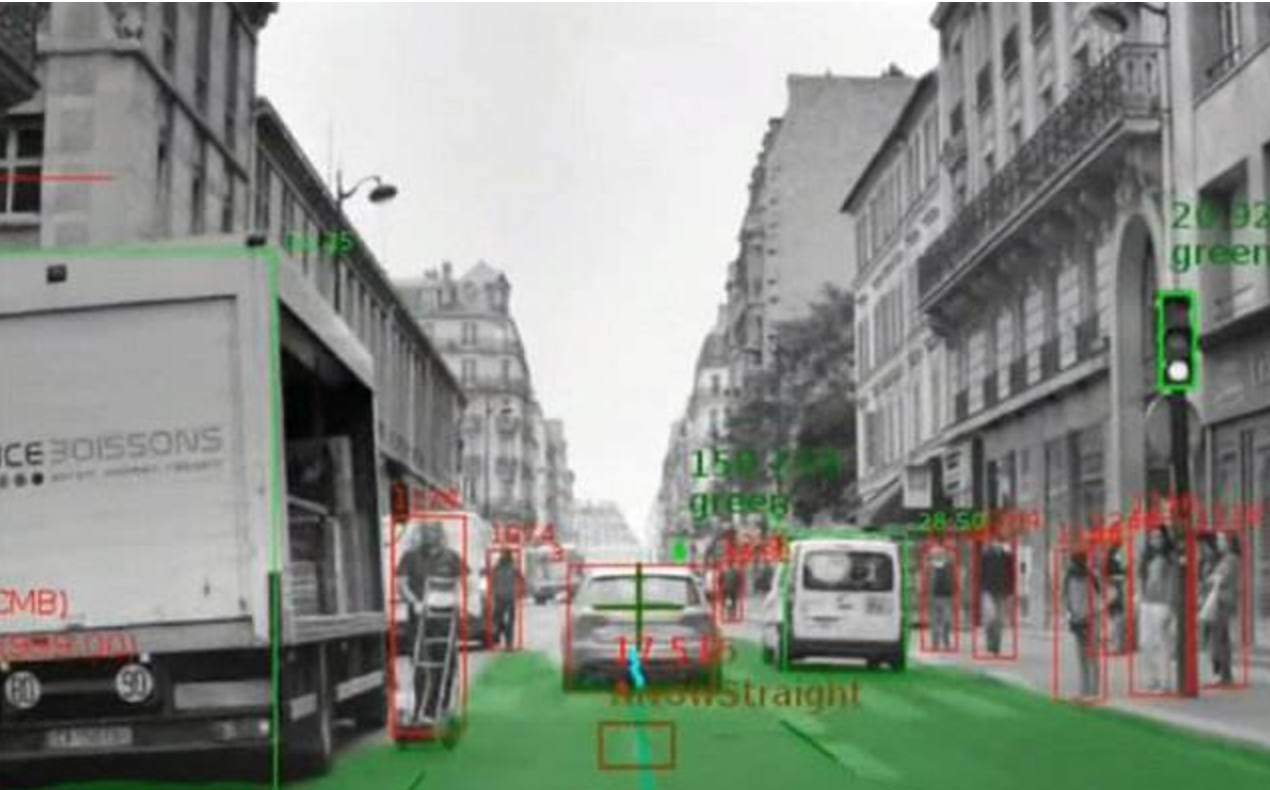

说回到刚被巨款收购的 Mobileye,作为驾驶辅助和自动驾驶视觉识别领域的领导者,Mobileye 将道路感知分为了三部分:物体识别、行驶路径识别和可行驶区域识别。

拿上图做个例子,圈出的部分就是 Mobileye 单目摄像头所识别出的物体。首先要知道的是,这已经是个非常黑科技的技术了,因为单摄像头的识别能力在硬件层面上,只是二维的图像,但 Mobileye 经过处理,已经能够在视觉识别时勾勒出物体的轮廓,将感测的维度从 2 维调整到了 3 维,这已经是有一部分感知中的“知”的体现了。

(2 维平面视觉识别)

将传统 2 维的图像识别多跟踪几帧,绘制出 3 维的环境信息后,交给自动驾驶大脑的信息量就完全不同了,传统 2 维信息是只能知道物体的大概位置和正面面积,但是拓展到 3 维后,车辆方向、车辆体积、具体位置都有了。

不要急,这只是识别出物体,最为关键的可行驶路径识别和可行驶区域还没有确定,这才是感知最为重要的地方。

低级驾驶辅助是根据路上的线来进行识别确定路径和可行区域,但这有几个问题,环境不好时候道路上的画线可能被遮挡干扰,很多路还没有线。所以这时候就要引入感知中的“知”来作为辅助,那就是深度学习。

通过多次试验,逐渐将道路的可行驶区域调整绘制出来,分辨出真正的道路和马路沿并且逐渐根据人类司机的行驶路径,在无画线道路画出适合行驶的初步路线。

说的这么复杂,但仔细一想,这些事情,其实一匹马就能办到。

感知还不算难,难在决策

人人都有眼睛,都能感知,但不是每个人都会开车,人类司机开车上路前也要学习技巧考个驾照,更不用说自动驾驶车型,比起感知,决策才是最为困难的事情。

如果是一匹马,遇到障碍它会判断这个障碍能不能跨过,能就跨过,不能就停下。看似简单的判断逻辑和过程,对于自动驾驶车,这样的决策过程则需要一个复杂的过程,看到障碍,识别出障碍,判断障碍危险性,做出应对障碍的决策,控制车辆躲避或直接跨过障碍,每一步都需要反复学习调校。

另一方面,在行驶时的驾驶策略选择也是需要通过不断调校进行,但比较困难的事情是,用深度学习的方式培养自动驾驶策略,往往得到的是端到端的结果而并非算法,也就是说,自动驾驶车感知周围环境后,会直接输出驾驶决策,这也就意味着,中间的决策过程失去了透明性。

就如同 AlphaGo 每下一步棋都是根据取胜概率,如果自动驾驶的决策都深度学习端到端的概率来定,那么驾驶决策的可靠性和安全性就会受到很大影响。

所以自动驾驶的决策更加适合因果推理,也就是完全透明过程的推理过程来导出最后的自动驾驶决策。这样就能避免端到端推理出现问题的状况。

举个例子:虽然每次自动驾驶车并线都能正常进行,但也许自动驾驶车判断的依据并不仅仅是旁边车道没有车且路况允许,也许是几次学习侧后方刚好都是白色车辆且车况允许,车就会并线,这样端到端的决策方式就会出现场景覆盖上的偏差。

所以对于自动驾驶车来学,进行调校学习驾驶技巧的过程,要远难于教一个新手司机开车或者教一匹马跑赛道。而且除了决策算法上的调校,要能做到决策的及时性,对于车载电脑的运算能力和运算速度需求也都有很高的要求,这些实现起来,也确实比感知这个过程更难。

别对自动驾驶太乐观,未来几年驾驶辅助才是主流

如果自动驾驶真的实现了,会是一种怎样的交通场景?

首先,最为理想的自动驾驶环境,就是尽量减少干扰的封闭路段,就像火车和地铁,而事实上,目前大多数火车和地铁都配备了不错的自动驾驶功能,但为什么很多线路还是要有驾驶员呢,主要还是为了应对突发的干扰。

本来行驶状况良好的地铁,在早高峰人拥挤时,关门时夹到了人,这样地铁就必须要重新打开车门,然后再次关门后才能开走。这种意外情况可以说,已经是不能常见更多。

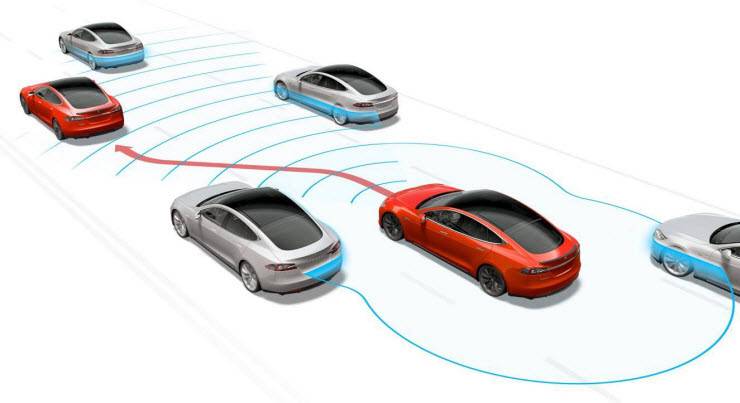

所以实际上,如果只是单一车辆拥有自动驾驶功能,那么调校再好的算法也很难灵活应付随时可能出现的各类干扰。

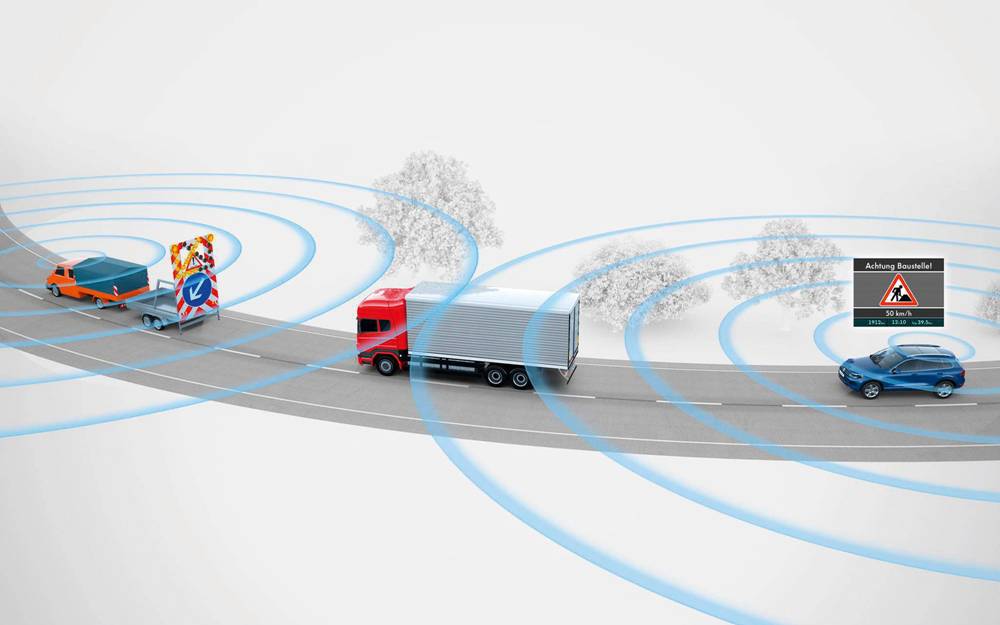

但我们可以看看大草原上奔跑的牛群和马群,尽管十分拥挤,但是由于互相都能感知到位置,所以虽然看上去混乱但整个群体却有序运动。

这就如同福特在 2017 年北美车展上给出的全自动驾驶概念一样,血液的“交通”系统远比人类的交通系统复杂,但人类的交通会堵车,但生物远不会堵车。关键是血液是一种既集体又独立的个体,能有机地用尽血管的空间;但人类的交通并没有这样的效率。交通愈能自动化,流动愈统一、愈充满活力。

所以当整个城市都变成无人驾驶的时候,并且全部通过系统连接起来;系统能透过整个汽车的联网,预测并规划不同汽车的去向。我们不再需要交通灯、也不需要车道、更不需要车速限制,由整个交通系统去调动,加速、超车;不断自动完善的系统会取代死板的交通规则。为什么自动驾驶系统更安全?不是因为什么超级电脑或激光雷达,而是因为这是会不断自我调整的有机系统。

然而从技术层面上,整个系统的调配难度,是要高于目前无人驾车车单一车辆避障自动行驶的研发方向的。所以在未来 3-5 年内,爱范儿编辑张博文认为性能更好的驾驶辅助系统仍会是市面上的主流,而真正对人类交通生活产生革命性影响的,在短期内可能会是驾驶辅助而非概念上的完全自动驾驶。

就如同一辆马车,路况良好时放手让马自由驰骋,道路环境复杂时再抓紧缰绳自主控制,在整个交通系统还未进化为适应全自动驾驶的生态时,这样的方式更加理性安全。

更别说,从现在的技术层面来看,很多高级驾驶辅助车,或者是试验中的自动驾驶车,智能和可靠程度,还不如一匹马。