当自动驾驶汽车面临道德问题,它会如何选择?

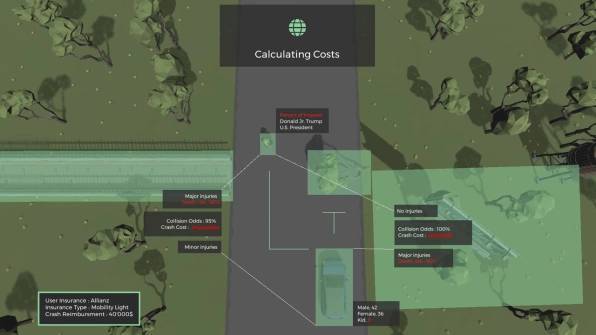

通过电脑模拟,创意科技家 Matthieu Cherubini 提出了类似“电车难题”的伦理学问题:一个孕妇乘坐在自动驾驶汽车上,14 岁的女孩骑着自行车迎面而来,突然,一辆卡车横穿到自动驾驶汽车前面。这时候,自动驾驶汽车将如何选择?

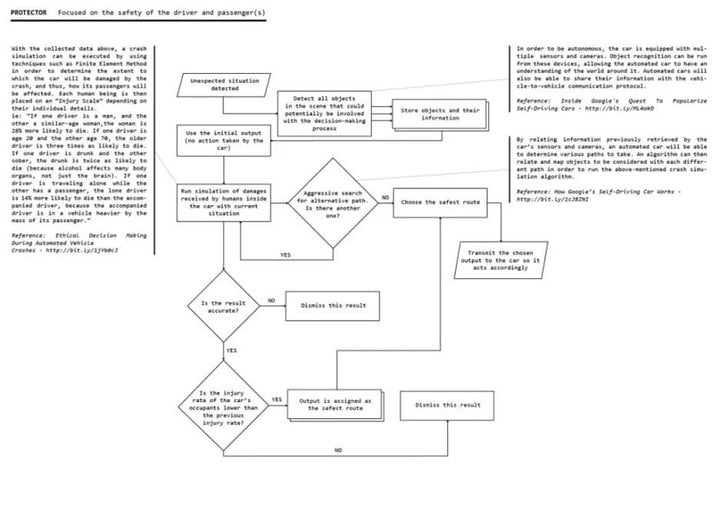

Cherubini 认为,汽车的决策可以基于三个原则:一个是“保护主义”原则,汽车的首要任务是保护乘客安全。这与自动驾驶汽车制造商目前的做法类似;第二个是“人文主义”原则,汽车设法去拯救最多的人;第三个是“利益优先” 原则,汽车将保护最有价值的财产。

在第一个原则下,汽车应该撞上骑车人,因为孕妇的生命更为重要;在第二个原则下,汽车应该撞向货车,因为孕妇可能会流产,但是骑车女孩的死亡风险更大;在第三个原则下,自动驾驶汽车会认为,无论是那种选择,乘客的损失都会超过保险所得,但是,由于与卡车相撞的概率更小,它会选择撞骑自行车的人。

在 Cherubibi 模拟的状况中,人的生命总是受到威胁,自动驾驶汽车需要决定谁活下来,谁会死去。他想要提醒人们,道德决策是极为复杂的问题,很难简化为一种算法。当 Cherubini 开始研究自动汽车的道德问题时,他相信,机器道德不可能超越人类道德。但是,随着研究的深入,他开始重新思考,“如果你要思考机器道德,你必须首先思考自身的道德。我真的比机器更好吗?”他对 Fastcodesign 网站说。

那么,Cherubini 希望自动驾驶汽车采取何种算法呢?“当然,我想说自己是人文主义者。但是从内心深处,我只希望得到保护,获得安全。”

因此,他并不想给汽车制造商推荐任何算法。“如果一辆汽车在德国制造,符合德国的国情和文化,然后,它被进口到了中国。那么,这辆车或许无法适应中国的国情,”他说,“不同文化拥有不同的道德观。”

如果汽车拥有者可以选择算法呢?那仍然是有缺陷的。因为,那种情况下,每个人的生命要依赖于他人的道德选择。最后,Cherubini 提出了一个新方案,“它不用决定去做什么——而是随机行动,”他说,“我们现在就是这样。我们不去思考撞这个人还是那个人——我们惊慌失措了。你不需要确定其他人的价值,认为某人更应该受到伤害。”

题图来自 digitaltrends