韩国 N 号房再现!大量女性被 AI 换脸在微博求助,涉及 500 所学校,超过 22 万人参与

上世纪末的作品《攻壳机动队》中,全身义体化的素子,怀疑自己是否仍然存在。身体、记忆和其他人的关系,当这些事物都能够被复制,也就无法成为肉身生命的论据。

AI 歌手爆火之时,孙燕姿也在回应里提出类似的观点,你并不特别,你已经是可预测的,而且不幸你也是可定制的。

我们可以加上一句,任何人都是可以被 AI 描述和生成的,哪怕你从未做过某些事情。

鲁迅真的说过,一见短袖子,立刻想到白臂膊。人类的想象力是共通的,毫不意外,每当技术有新进展,某个垂直赛道会被开发得越发成熟:搞黄色。

曾经因为 N 号房震惊世界的韩国,此时此刻正在上演 2.0 版本。

普通人对普通人的暴力

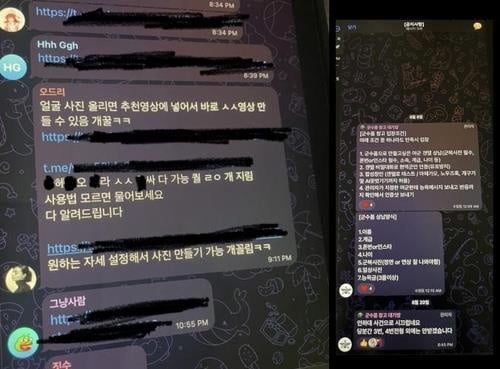

之前的 N 号房事件,作案人在加密即时通讯软件 Telegram 上建立多个聊天室,发布性剥削内容。这次的事件,也主要发生在 Telegram。

两者主要是犯罪手段的区别:一个是偷拍,一个是 Deepfake(深度伪造)。

我们早已对 Deepfake 不陌生,它利用 AI 生成看似真实的视频、音频或图像,模拟实际没有发生的事情。

Deepfake 常用在娱乐圈和政治人物,但它也正被普通人所掌控,拿来伤害其他普通人。

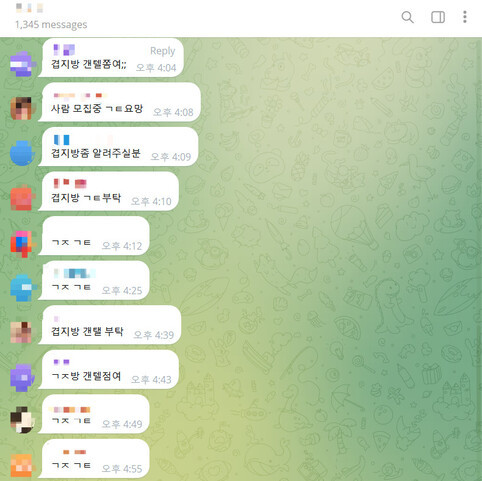

N 号房 2.0 的加害人们,将魔爪伸向了身边的家人、同事和同学,很多 Telegram 聊天室按照学校或者地区组织,所以群友有共同的熟人、臭味相投的话题。

▲ 按高校区分的聊天室

除了身边女性,女明星也是他们围猎的对象。有些聊天室甚至细分到了职业类型,包括教师、护士、军人等。

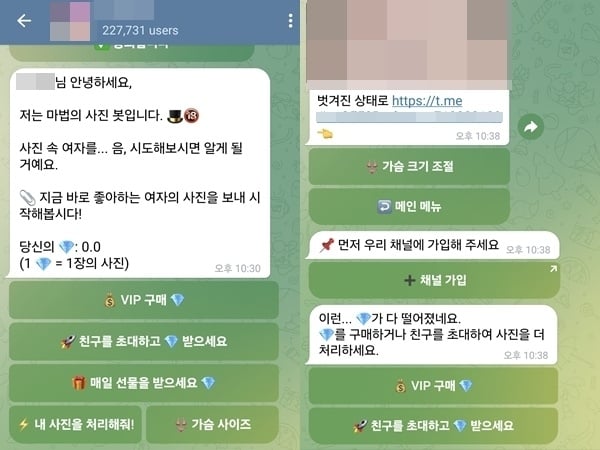

《韩民族日报》报道,一个 22.7 万人参与的 Telegram 聊天室,只需要女性的照片,就能在 5 到 7 秒内生成 Deepfake 内容。

22 万什么概念?韩国 2023 年新生儿人数只有 23 万,总人口数只有 5000 多万。

这个聊天室内置一个将女性照片合成为裸照、并能调整胸部的机器人,用户进入聊天室后,聊天窗口会立即弹出消息:「现在发送你喜欢的女性照片。」

▲ 聊天室截图,说明 Deepfake 的使用方法

参与者数量多到令人发指,或许和「准入门槛」不高有关:在 X(原Twitter)通过搜索特定关键词就可以找到链接。

这个聊天室还建立了变现模式。前两张照片免费,之后收费,每张照片收费 1 钻石(0.49 美元,约 3.47 人民币)。支付只能用虚拟货币,以便匿名。如果邀请朋友,也可以拿到一些免费额度。

但也有些聊天室需要「投名状」——想进群,先提交 10 张认识的人的照片,并通过面试。

聊天软件 KakaoTalk 的头像、Instagram 的照片,都可以作为「原材料」。

更细思极恐的是,受害者和加害者里,青少年的比例都不小。

志愿者们做了实时更新的地图,显示犯罪发生在哪些学校。就算是女子学校也会有受害者,因为加害者不一定是同学。

到底有多少学校受到影响,目前还没有定论。有博主称,这次涉及了超过 70% 的学校。

8 月 26 日,《韩国中央日报》指出,至少包括全国约 300 所的学校,其中甚至还有小学。8 月 28 日,WSJ 的报道又将数字扩大到了约 500 所。

一位网友在评论区感叹:「这基本上就是整个韩国了……」

虽然此次事件还没有明确的调查结果,但过去的数据也能说明情况的严重性。

韩国妇女人权研究所统计,从今年 1 月到 8 月,共有 781 名 Deepfake 受害者寻求帮助,其中有 288 名未成年人,占比 36.9%。真实数字可能远高于此。

另外,韩国国家警察厅称,自 2023 年初,约 300 名被指控制作和分发虚假裸照的人中,约 70% 是青少年。

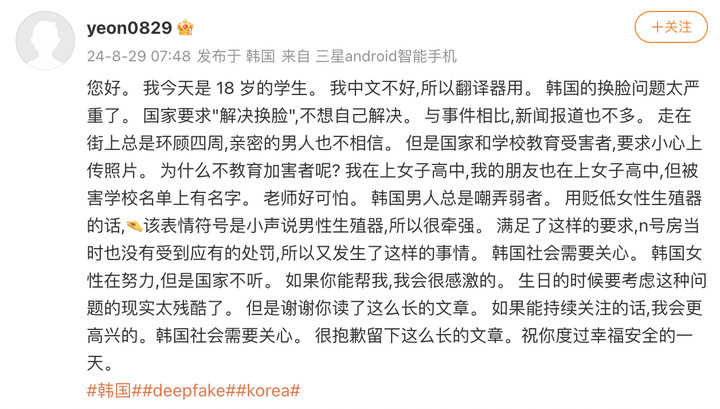

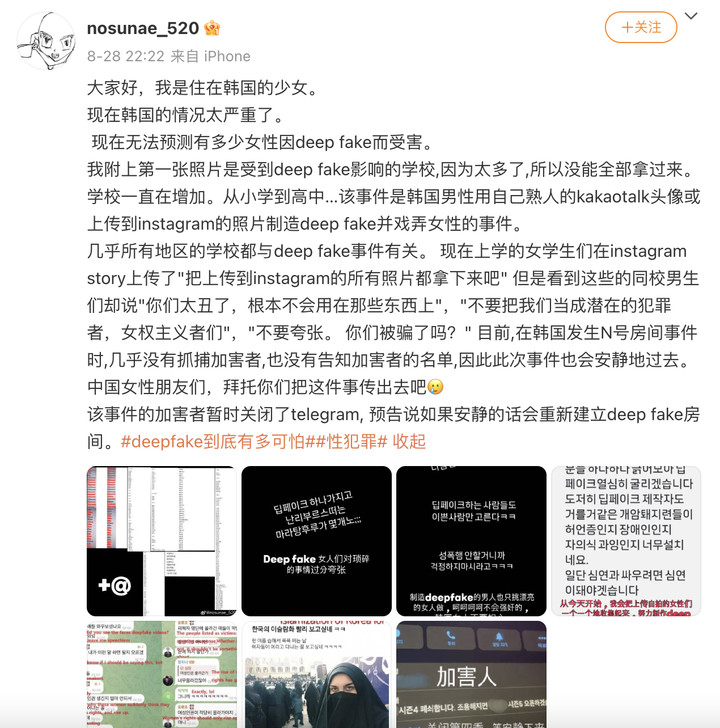

不少韩国女性到微博发出求助,她们不会中文,只能机翻内容,传递无助和恐惧,「N 号房 2.0」一度冲上微博热搜。

有些网友奇怪为什么韩国女性跑到中文互联网求助,其实不只是中文,韩国女性也有用其他语言发声,除了韩国内部,新加坡、土耳其等国的媒体也报道了这起事件。

她们认为,被外国人关注和批评的话,媒体会更积极地报道,相关部门会更认真地调查,而不是装聋作哑和息事宁人。

一些犯罪证据乃至始作俑者的身份,是韩国女性自己调查的,类似当年的 N 号房。好在,韩国总统和在野党领袖已经表态了,韩国总统尹锡悦提出:

Deepfake 是一种明确的数字性犯罪,我们将彻底根除它们。

Deepfake 可能被看作是恶作剧,但它显然是在匿名掩护下利用技术的犯罪行为,任何人都可能成为受害者。

Telegram 的服务器在海外,其首席执行官又被拘留在巴黎,所以调查起来有困难。韩国通信标准委员会表示已经致函,要求法国政府配合调查 Telegram。

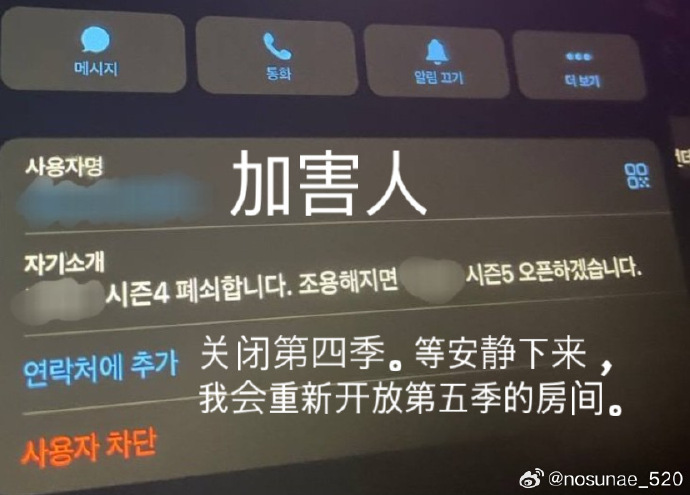

被舆论关注之后,相关行为有所收敛,但《韩民族日报》又跟踪报道发现,有些贼心不死的用户,会通过更严格的「身份验证」,在更私密的聊天室继续 Deepfake。

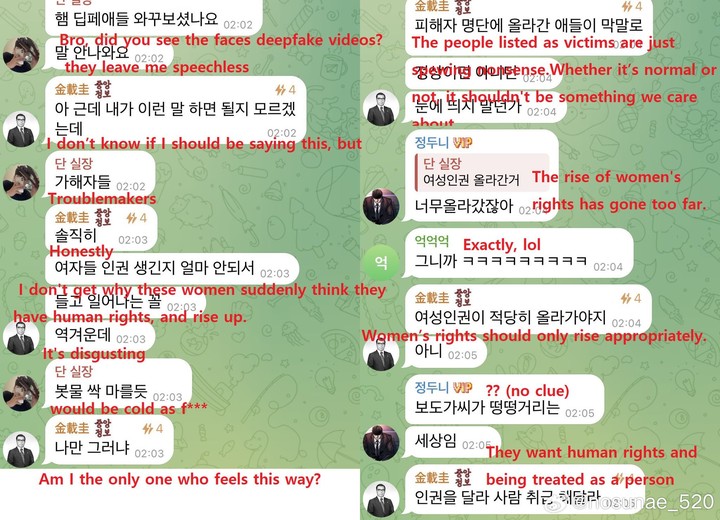

▲聊天室截图,用户讨论加入更私密的聊天室

虚假的内容,真实的伤害

Deepfake 不是新鲜事,但它的伤害其实很少被正视。

韩国一些女性将自己的社交账号设为私密,或者删除发布在网上的照片,尝试做些补救。

她们既痛苦,又怀疑。一方面,她们不知道,自己的照片被分享到了哪,传播了多远。另一方面,她们不理解,为什么都在要求受害者小心上传照片,而不是教育加害者。

当女学生在 Instagram 的 Story(快拍)呼吁「把上传的所有照片都拿下来吧」,同校男生们却能说出「你们太丑了,根本不会用在那些东西上」这种荒谬言论。

▲加害者的言论,说女性站得太高了

网上还不乏这样的声音:「不知道这种犯罪为什么会造成很大的伤害。」「如果是几个人自己制作的,伤害应该很小吧。」

但受害者们所经历的,不仅是看到自己的脸被 Deepfake。加害者们还会侮辱她们,散布她们的地址、电话、学生证等个人信息,造谣她们的私生活,接近并骚扰她们。

更可怕的是遇上「复仇色情」——加害者以传播 Deepfake 材料为威胁,勒索和伤害女性,造成更严重的二次伤害。

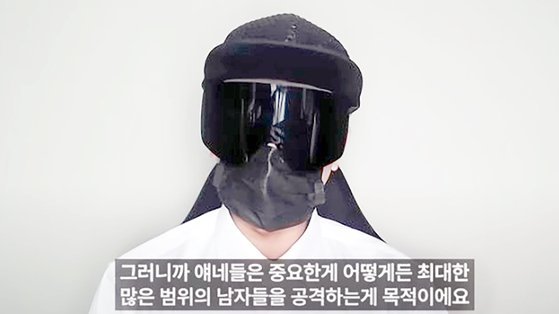

▲一个韩国 YouTuber 说女性大惊小怪,但他知道蒙面保护自己

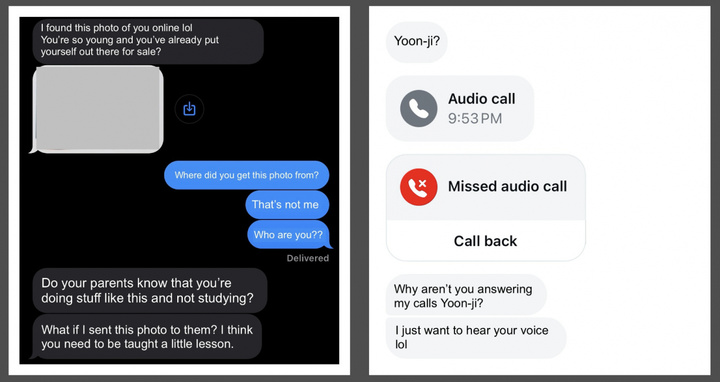

《韩国先驱报》报道,17 岁的京畿道高中生 Song,以前经常在网上分享一些跳舞的照片和短视频。一天,她在 Instagram 收到了一条附有三张露骨照片的匿名消息:「你的朋友和父母了解你生活的这一面吗?」

这些照片都是 Deepfake 的,但几乎没法和真实图像区分。噩梦没有结束,她回复的消息,只会让对方更兴奋、提出更多的要求。

▲Song 和加害者的短信截图,根据 Song 的要求进行了修改并翻译成英文

没有谁能分担痛苦。甚至有受害者表示:「我所知道的世界已经崩塌了。」

这和加害者为此付出的代价不对等。

▲聊天室截图,一些猥琐发言,如「可以设定你想要的姿势来制作照片,超爽」

此次事件尚未尘埃落定,但韩国之前有对 Deepfake 判决,其中一起在 8 月 28 日进行了一审。

从 2020 年 7 月到今年 4 月,朴某盗用大学校友等女性受害者的脸部照片,制作了 419 个 Deepfake 色情视频,并传播了 1735 个,被判处有期徒刑 5 年。

受害者们从 2021 年 7 月开始辗转奔走,才成功将加害者推上审判台,让朴某在今年 5 月被起诉。

因为这次大型 Deepfake 事件,韩国相关部门考虑,将最高刑期从 5 年提高到 7 年。

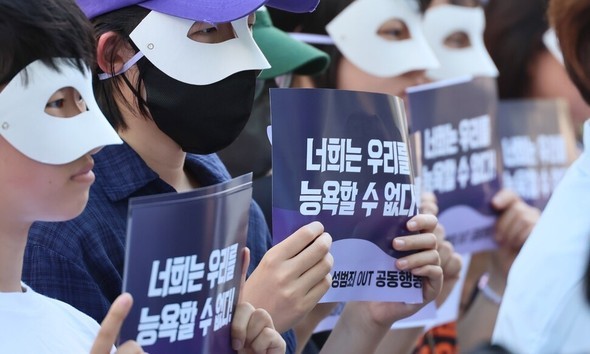

▲韩国女性发声,抗议性犯罪

又考虑到 Deepfake 的青少年犯罪很常见,但法律有漏洞,韩国正在衡量义务教育阶段作案人的最高惩罚。

时至今日,Deepfake 在很多地方仍是灰色地带,保护力度跟不上威胁速度。

比如在美国,如果受害者是成年人,各州有不同的法律规定,或定为刑事犯罪,或提起民事诉讼,但目前还没有联邦层面的法律禁止制作 Deepfake 色情内容。

▲聊天室截图,成员聊共同的熟人

之所以立法困难,一个原因在于,有些观点认为,Deepfake 图片里的主体就算长得像你,实际并不是你,所以你的隐私并没有真正受到侵犯。

然而谁都清楚,图片虽然虚假,伤害是真实存在的。

法律推进缓慢,与此同时,那些未曾露面的加害者,暂时「偃旗息鼓」,等待「卷土重来」。

作恶如此简单,Deepfake 和所有人有关

韩国并非个例,Deepfake 的发生不限国界。

2023 年 9 月,西班牙的小镇阿尔门德拉莱霍,一群男生将女同学发在社交媒体的照片上传到了一款「一键脱衣」AI 工具。小镇有五所中学,女同学的「裸照」在至少四所流传。

这款工具可以通过手机 app 或者 Telegram 使用,受害者至少有 30 名,主要是 12 岁到 14 岁的女学生。

始作俑者大多和她们认识,也是未成年人,至少有 10 名,部分甚至未满 14 岁,不能面临刑事指控。

▲一位母亲呼吁更多受害者站出来

他们在 WhatsApp 和 Telegram 创建群聊传播这些「裸照」,通过 Instagram 威胁受害者,勒索「赎金」和真人裸照。

美国新泽西州的一所高中发生过类似的情况,受害者也在 30 名左右,她们的男性同学在暑假制作了「裸照」。

校长保证,所有图片已被删除,不会再被传播,始作俑者被停学了几天,又像没事人一样回到「案发地点」。

Deepfake 最早兴起于 2017 年的「美版贴吧」Reddit,主要形式是将明星的脸替换到色情视频的主角身上,或者恶搞政界人物。

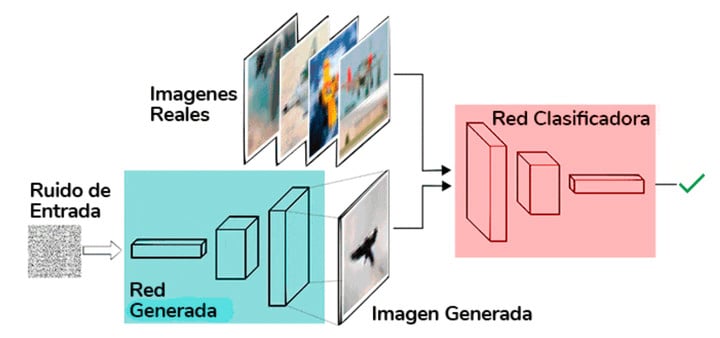

从技术原理来说,主要有两条路径:一是编码器-解码器路径,通过将图像进行压缩和重建,将一张脸替换成另一张脸;二是生成器-鉴别器路径(即生成对抗网络,GAN),通过对抗训练生成逼真的图像。

▲GAN

如今,Deepfake 是一个更为广义的概念,不再仅限于最初的面部替换,我们用它来指代通过技术手段伪造现实的一切行为。

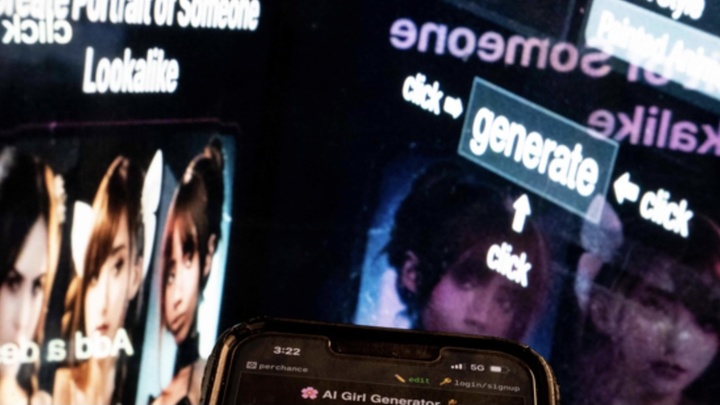

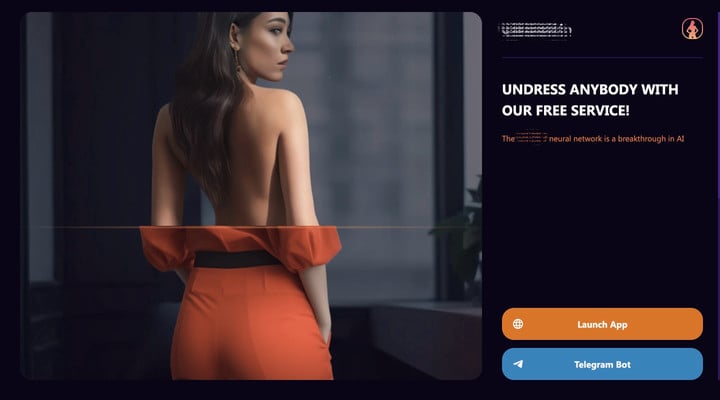

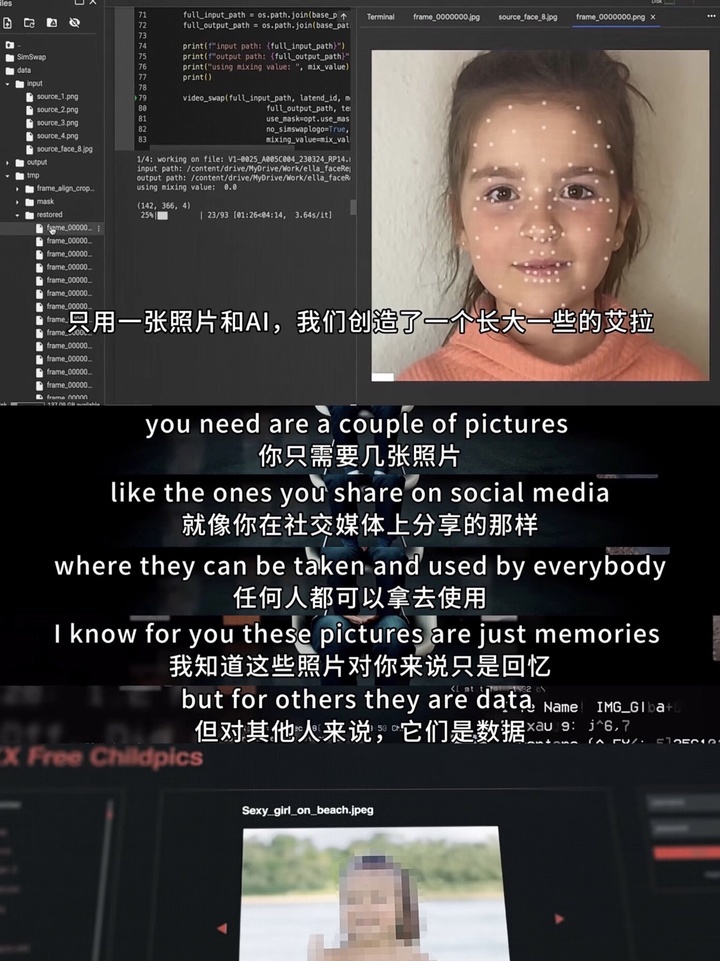

复杂的技术原理隐藏幕后,在用户面前的是一个个「开箱即用」的界面,青少年们也能随手制造虚假信息,Deepfake 从一门技术,堕落为几乎没有门槛的工具。

「一键脱衣」的 app 们,只需要一张照片、一个电子邮件地址和几美元,就可以批量脱掉名人、同学、陌生人的「衣服」,被用来「脱衣」的图片,往往从社交媒体获取,未经发布者同意,然后也在他们不知情的情况下传播。

基于接受过海量图片训练的开源扩散模型,用户可以通过输入提示词的方式,生成名人的虚假露骨照片。

▲好莱坞女星的 AI 模型,已经下载上千次

像 Deep-Live-Cam 这样的开源 GitHub 项目,通过一张照片,就能在视频聊天中换脸。

骗过年轻人或许有难度,但是长辈们就不一定了,现实的惨痛例子已经上演——美国的一位 82 岁老人,因为盲信在视频里坑蒙拐骗的 AI 马斯克,损失了 69 万美元的退休金。

▲ AI 马斯克的直播

2023 年 7 月,德国电信发了一条关于儿童数据安全的广告,呼吁家长尽量少在互联网分享儿童隐私。

图像、视频和音频,都在被 Deepfake,虽然理智明白「眼见为实」成了过去时,但我们的心理还没有完全接受,也不具备对应的分辨能力,所有人都可能成为受害者。

技术或许中立,但人用技术产出的信息不只是信息,也是用来进行羞辱、污名和获得优越感的武器。越低俗和猎奇的内容,越容易传播,自古皆然。

普通人可以做些什么?至少我们可以决定自己如何使用技术,也可以选择产出和传播什么信息,对受害者给予关注,对加害者嗤之以鼻,以微末的力量,推动法律和社会观念的进步。

被换脸,为什么是受害者删除照片?被偷拍,为什么是受害者深感羞耻?这似乎是技术也没法回答的问题。