你信嘛?谁都能假装你跟别人视频

现如今你收到一个好友的借钱短信,第一反应不是直接打钱而是先找本人确认,其中视频无疑是最能够获得别人信任的一种确认方式。据 《华尔街日报》报道,一组来自美国和德国的研究人员最近成功的实时将面部表情和嘴唇运动从一个人的脸,转移到另一个人的脸上。

该方法被命名为“面部表情重新设定(Facial Expression Re-enactment)”,由纽伦堡大学,德国 Max Planck 学会和斯坦福大学的研究者联合开发。这项研究还应用了来自 NVIDIA 的图形芯片,后者还提供了部分硬件。这个方法也将在 11 月上旬的日本神户计算机图形会议正式提交。

黑科技如何实现的?

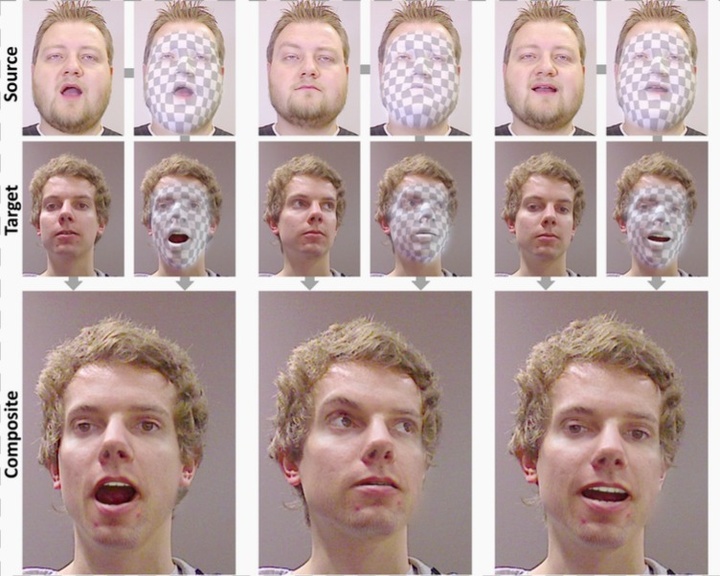

下面是它的工作原理:首先识别两个人的面孔,包括皮肤颜色,形状,头部姿态等参数。这些都需要一个能够捕获编码颜色和深度数据的摄像头来完成,硬件如微软 Kinect 的或华硕 Xtion PRO , 当然他们的实时动作也会被记录下来。

软件会自动生成与目标相似的模拟嘴的图片,但不会处理的眼部运动。 它还会增加阴影和其他灯光效果,给人一种在真实说话的错觉。 下一步,软件将面部活动通过数字呈现的方式加载到目标的脸,调整肤色,头形,头部运动和照明, 最后是动态皮肤的细节,如皱纹和褶皱。

最终的效果是,替换目标面部看起来正在说另一个人所在说的话。

视频信任真的有危机?

放心,这套系统并不会调整源的语音语调来匹配目标的,当然这也是下一步研究中的一个非常有趣的方向。虽然该系统为半成品,但它在虚拟现实和视频编辑期间的多语言视频会议的实时翻译等领域的前景可以期待。开发者 Niessner 在接受采访时说:

“对于声音的仿冒是很难的,目前仍然不成熟。”

也有人指出,这项技术如果被用歪了的话同样会造成非常坏的影响,如允许假冒他人进行现场直播或生产假冒视频勒索。对此,开发者 Niessner 表示这项技术也能反过来可以用来检测假视频,对目标源和灯光之间的分析就能做到这一点。而且目前他们已经收到了来自心理学家以及音乐视频相关应用方面的测试请求。他最后说到:

“重要的是让人们意识到这一点,并且将技术手段开发出来,使得他们可以反向监控这种操作,”

总体来看,绝对是黑科技无疑,但由于声纹模仿仍然不成熟,想完全假冒他人暂时还做不到。反正以后别人找你借钱,确认的时候记得打电话,就别视频了。

题图来自 movieboozer