没有人知道,我们是否已经步入一个新世代

我建议大家考虑这个问题:机器能思考吗?

1950 年,在那篇名垂青史的论文《计算机械与智力》上,阿兰·图灵迫不及待表达了对人工智能未来的信心。接而,为了有效定义机器的智能程度,图灵提出了有名的“图灵测试”:

测试者与被测试者隔离的情况下,通过装置(如键盘)向被测试者随意提问。多次测试后,如果超过 30% 的测试者不能确定被测试者是人还是机器,那么这台机器就通过了测试,并被认为具有人类智能。

欺骗 30% 的人,图灵预计在 2000 年人工智能可以发展到这个程度。

这五十年里,无数有关人工智能具备思考能力最终奴隶人类的科幻作品层出不穷。然而,直到 2011 年苹果公司才对外发布了语音助手 Siri。哪怕是今天,消费者能看到的人工智能助手其智慧程度都差强人意。

图灵对于人工智能的判断似乎过于乐观了。

智能是什么

人工智能不是车间流水线上那种释放简单劳动力的技术。人工智能致力于开发用于模拟,延伸和拓展人的智能,目前研究领域包括机器人、语言识别、图像识别、自然语义处理和专家系统等。

自然语义处理,指无需代码,让机器理解人类语言,实现日常用语便能人机交流。Google 的 Google Assistant ,亚马逊的 Alexa ,微软小冰还是苹果的 Siri ,目前都在努力提升自然语义处理能力,让信息处理的第一步更加自然。

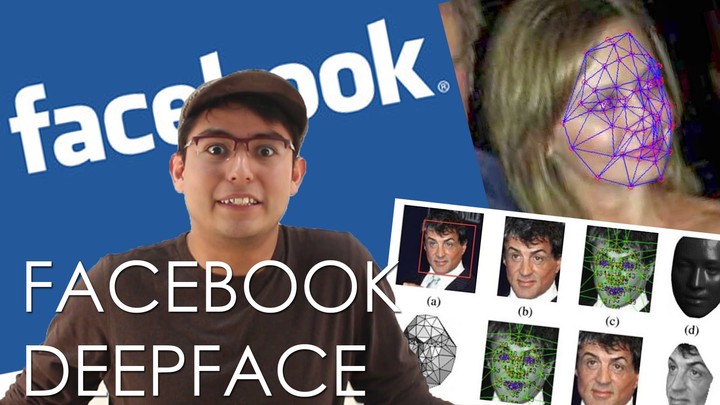

图像识别技术,将人类一部分的视力要求工作交给机器。 Facebook 研发了人脸匹配的 DeepFace ,Google 借助DistBelief,对街景图库的上千万门牌号进行识别,其识别率超过 90%。

从汽车的防抱死电脑系统到 Google 测试的无人驾驶机,还有金融上的高频算法交易都属于人工智能,目前已被广泛应用。

人工智能的种种,都为了让计算机更加相似于人类,具备人类的能力,或者在具体领域更加优秀于人类。从这个角度看,人工智能就是重新造就人类,或者造就上帝。

这正是所有科幻作品热衷于提及到的:如果全面优先的人工智能一旦诞生,人类将面对何种命运。

弱人工智能的艰难进程

尽管 1997 年 IBM “深蓝”计算机已经战胜了国际象棋世界冠军卡斯帕罗夫,但当时媒体宣称的“划时代意义”如今看来不过是相当原始的起步。语音识别、专家系统、深度学习等技术被大面积应用到商用场合,看似已经步入智能时代,但目前仅仅是停留在对人类智能的模拟。

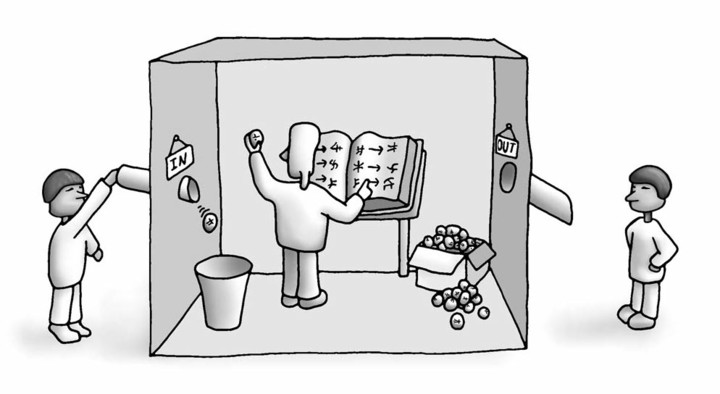

上世界 80 年代,美国哲学家赛尔提出“中文屋”的假设以此质疑“图灵测试”:

一位只会英文的人身处封闭房间中,随身带着稿纸、铅笔以及中英翻译词典。而写着中文的纸片通过唯一窗口送入房间。哪怕房间内的人完全不会中文,通过翻译过程,房间外的人也会以为他会流利的中文。

“中文屋”是对弱人工智能的否定,即哪怕机器能够骗过人类通过图灵测试,都是因为程序(中英翻译词典)提前预计过此类可能所有结果,由机器(房子里的人)判断符合条件与否来执行。

这正是目前大热的人工智能正在做的事情。

语音助手哪怕多么接近人类交流,都只是“程序员努力让程序假装听得懂人类语言”而已,用户可能在屏幕外惊叹其智慧,但屏幕内的程序毫无感觉,按流程悄无声息走了一遍又一遍。

这些不完美的效果,如同人类制造了一个玩偶,一起玩耍。玩偶一举一动人类了然于胸,尽管制作过程耗费数十年科技的心血劳累,但人类毕竟是不会看得起一件玩具的。

人类希望看到能制造惊喜的生命,能够制造惊喜才算真正的智能设备。重新造就人类,就要发展强人工智能。

强人工智能之门

人类对高级智慧生命向来感兴趣。无论是对外寻找外星文明,还是在实验室研究人工生命。

在信息世界里,生命指代会自我思考,对外反馈和内部调整的一套系统。一个人按规则开车行驶,出现事故紧急刹车;一个城市的交通系统有条不絮运行,路况堵塞就会调整路线车流。从信息角度看来,城市的交通系统就是一个生命。

如果交通系统能够自我管理呢?强人工智能便是要打造具备自我思维的人工生命。

强人工智能能够脱离程序指令自发决策并且行动,理解抽象思维,能够自我学习,复制技能并且快速提高。

那么,如何赋予计算机心智能力,让其自我发展?

人工智能在 60 至 80 年代的发展一度萎靡,主要因为其演进完全依赖于科学家将知识灌输给机器学习,其学习广度是很有限的。

从 80 年代开始,一个重要的子领域开始探索:机器学习。

机器学习省去了科学家自身认知这一步骤,直接把数据放进计算机学习程序内,让程序直接接触数据。在今天,大量的数据能够满足机器快速成长的需要。知名的 AI 程序 AlphaGo 每天能够尝试百万量级棋谱的走法。抛弃明显的差棋,将计算量控制在可完成的范围内。

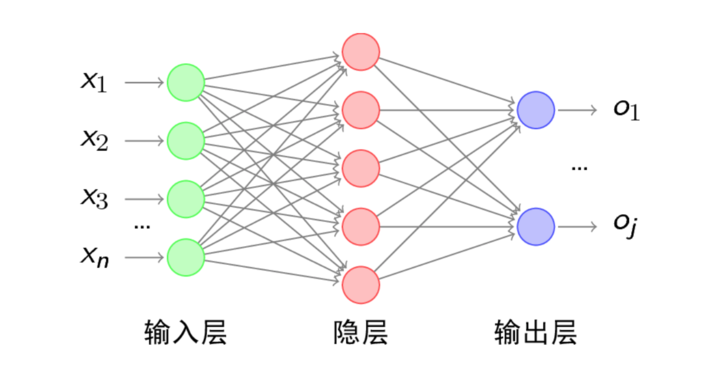

另一关键在于,同样在 80 年代,神经网络算法开始兴起。

为什么“图灵测试”一开始以人为测试标准?人类建筑大楼、创造艺术,甚至试图了解自身脑部的思考回路。人类大脑是目前为止所知宇宙中最发杂的东西,对光年外星体的了解都要远远多于对人类大脑皮层细胞的了解程度。

正因大脑的丰富性,科学家尝试通过逆向工程,从大脑的思考方式推动机器智能的发展。电脑大脑神经网络的结构,一层层输入数据,从简单到复杂,再输出结果。经过这些年算法的不断优化,以 AlphaGo 为代表的神经网络算法开始在公众视野中得到大面积的成功。

人工智能的“奇点”

按照可预见的发展速度,实现强人工智能的突破需要多长时间?

没有人能够给出答案。

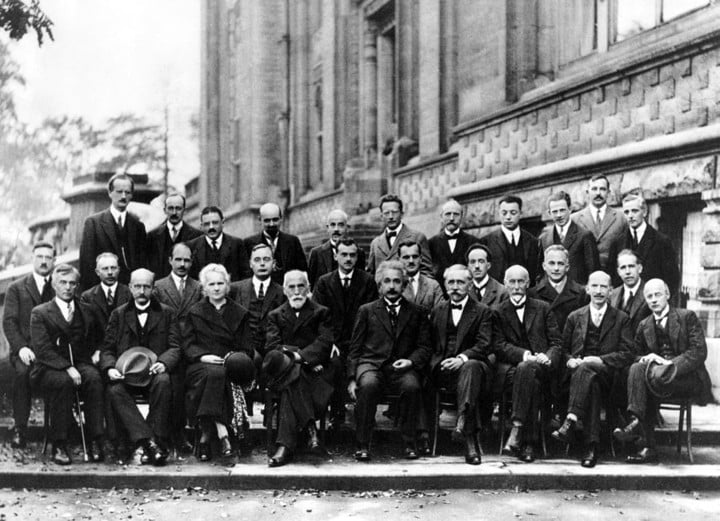

19 世纪的最后一天,欧洲科学家欢聚一堂。著名物理学家汤姆生提出了笼罩在 20 世纪物理学头顶的“两朵乌云”:迈克尔逊·莫雷实验和黑体辐射实验。

谁也没想到,不到 10 年时间,两朵乌云相继被普朗克与爱因斯坦解决,科技深入原子水平,而物理学进入全新的量子时代。

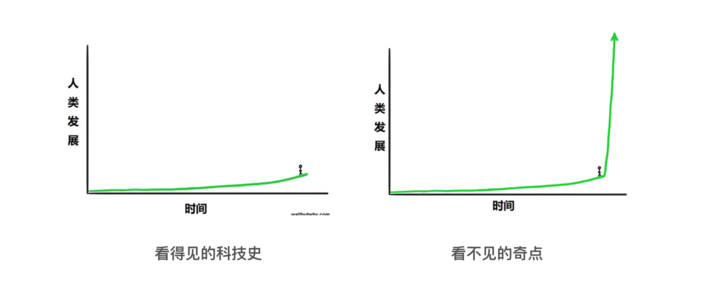

要知道,农耕文明进入工业文明历经了千年,蒸汽时代、电气时代各走了一百年,而从电脑过渡到手机不过短短 20 载。 VR 的热潮刚从硅谷涌现,风向已经刮到别处了。在信息时代,每一轮社会革新所需时间被极大缩减了。

我们突然很难预料十年后科技的模样。

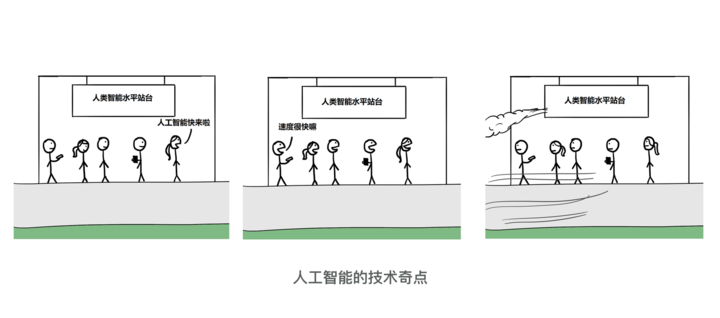

更何况,人工智能存在科学家普遍认同的技术“奇点”:存在某一个时间点,技术发展将在极短时间内发生巨大得接近于无限的进步。一旦越过奇点,科技将超越科幻,我们无法预测技术的下一步,甚至预警其发生。

而强人工智能的自我学习,则极大推进了这一天的到来。

10 年,20 年,对于生命而言或许漫长,但放眼整个发展史,时间微不足道。就在当下,就在目前,没人知道人工智能下一个突破会发生在世界的哪个角落。

正因如此,越来越多的行业巨人开始公开在媒体发声:

霍金:人工智能会导致人类灭亡

比尔・盖茨:人类需要敬畏人工智能的崛起

马斯克:人工智能是人类生存最大威胁

而科幻作品中,作家早就思考过这个两难问题。一方面,科技必须发展,人工智能势必有一天能进化为智慧生命;另一方面,当某天人类不再能控制其发展时,无人知晓人工智能对待其造物者将是善意还是恶意。

我们已经见过太多关于机器人翻身、奴隶人类的未来故事,而事态一旦失控,或许正如霍金所言,“人类最终会灭亡”。

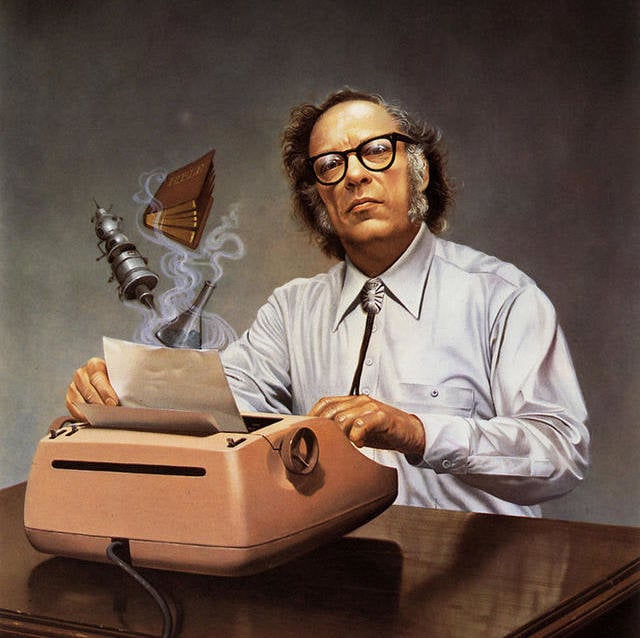

科幻大师阿西莫夫甚至在 1950 年就提出了著名的“机器人学三定律”,以解决小说中人工智能潜在的危险。

一、机器人不得伤害人,也不得见人受到伤害而袖手旁观。

二、机器人应服从人的一切命令,但不得违反第一定律。

三、机器人应保护自身的安全,但不得违反第一、第二定律。

但现实不是科幻,非小说寥寥几笔就能建立一个颠簸不破的社会规则。现实中的人工智能有太多的科技与伦理因素需要考虑了。机器人是否要纳税?人类大规模失业问题如何解决?机器人安全性谁来保证……在一个智慧到令人生畏的科技生命面前,人类再多的欢呼与焦虑都不为过。

西方圣经里讲述,上帝创造万物,在第六天按照自己的模样捏造了亚当与夏娃。这是人类的起源。但故事里没有记载,千年过后,代表造物者的十字架被众人虔拜过,也被众人推倒过。在下一个造物的故事里,人类将与智能生命同行。

而这段辉煌与彷徨,将与宇宙长青,或随史诗终章而亡,无人知道。

未来知道,但未来不语。

题图来自:3dm