“钢铁侠”马斯克与人工智能的中场战事

多年以后,当伊隆·马斯克(Elon Musk)带着幸存的人类搭上 SpaceX 逃到火星,地球已经失守,人类终究还是败给了人工智能。站在荒凉的异星,马斯克想起了那个遥远的午后,他驾驶着搭配 Autopilot 8.1 自动驾驶系统的 Model S 赶往加州阿西洛马的会场,与霍金等人谋划如何防止人工智能失控。

前几天马斯克研究脑机连接技术的新公司 Neuralink 再次成为了科技圈的热点,从移动支付公司 PayPal、太空探索科技公司 SpaceX 到电动汽车厂商特斯拉,马斯克每一次创业都似乎要颠覆一些行业。

那这次马斯克要改变什么?可能真的是我们想太多了,马斯克所做的这一切可能只是为了对抗人工智能。 马斯克在今年2月在迪拜举行的“世界政府峰会”(WGS)上就曾表示:

人类需要与机器相结合,成为一种“半机器人”,从而避免被人工智能淘汰。

实际上,马斯克与人工智能的战役早就开始了。

向人工智能宣战

马斯克凭借 SpaceX 和特斯拉项目一跃成为硅谷备受瞩目的偶像人物,同时也被认为是最接近钢铁侠原型的人。现实中这位硅谷钢铁侠似乎真的想像超级英雄一样拯救人类,但不同的是,他不会像电影中的钢铁侠一样和自己的人工智能管家贾维斯并肩作战,反而认为硅谷对人工智能的追逐会最终引发灾难。

(图自:reddit)

2014 年,马斯克在麻省理工大学的演讲中第一次提出人工智能威胁论,称人工智能是人类面对的“最大生存威胁”,并可能会因此召唤出一个恶魔。此后便一发不可收拾,在去年的 Code Conference 大会,马斯克的人工智能威胁语录又增加了一句:

人类将沦为人工智能的宠物。

其实马斯克对人工智能的提防可能要比想象的早得多,在最近名利场的一篇文章《Elon Musk’s Billion-dollar Crusade to Stop the A.I. Apocalypse》中,就探讨了马斯克对人工智能的恐惧,其中提到 SpaceX 的火星移民计划可能也是马斯克对抗人工智能的一部分,马斯克称如果人工智能崛起,火星可以成为人类最后的避难所。马斯克甚至直言:

人类是第一个拥有自我毁灭能力的物种。

(图自:Universe Today)

马斯克对抗人工智能的手段当然不止是逃离地球,他决定以牙还牙,2015 年马斯克和几位好友共同出资 10 亿美元创立了一家非盈利性质的人工智能公司 Open AI,决定开发有利于人类的人工智能, Open AI 所取得的所有专利也将向公众开放。

马斯克在接受《名利场》采访时表示他其实并不反对 AI 发展,但他认为应该把相关技术向全世界公开,而不是集中在少数在科技与政府精英手中。此外马斯克还向生命未来研究所(FLI)赞助了 1000 万美元,进行人工智能安全研究。

(图自:新浪科技)

不过硅谷有不少人都对马斯克的人工智能威胁论嗤之以鼻,不少人工智能工程师时常调侃道,“走,我们去召唤恶魔吧。”甚至有人认为马斯克把自己塑造成一个对抗邪恶的正义形象,其实是为了帮自己招揽更多人才。马斯克也表示由于对人工智能观点的分歧,一度影响了他与 Google 创始人拉里·佩奇的的关系。

不过马斯克不是一个人在战斗,对抗人工智能的阵营正在不断壮大。在今年 1 月初举行的“Beneficial AI”会议上马斯克、霍金等全球 2000 多人,包括 844 名人工智能和机器人领域的专家联合签署了“阿西洛马人工智能原则”,向全世界呼吁在发展人工智能的同时严格遵守这 23 条原则,共同保障人类未来的利益和安全。马斯克在会议上发言时说:

我们正走向超级智能,亦或是人类文明的结束。

(Beneficial AI”会议会场)

而在去年 9 月,美国五大科技巨头(Google、Facebook、亚马逊、IBM、微软)也携手成立了人工智能合作组织(Partnership on AI),旨在为人工智能的研究制定和提供范例。

牛津哲学家,知名人工智能思想家 Nick Bostrom 在其著作《超级智能》的开头曾提到一个寓言,麻雀妈妈希望收养一只猫头鹰来帮助麻雀们筑巢和担当保镖,但是老麻雀却认为应该先学会驯服猫头鹰。

如今人工智能的浪潮再一次袭来,这个寓言似乎正在成为现实,或者说是一种警告。

第三次人工智能浪潮

在 AlphaGo 战胜李世石之前,人们对于人工智能的印象大部分来源于各种科幻电影。人工智能似乎一直以来都是一个带着科幻色彩的词汇,这让人们产生了人工智能从未被实现的错觉,而实际上人工智能的诞生比互联网还要早。

学习或者智能的任何其他特性的每一个方面都应能被精确地加以描述,使得机器可以对其进行模拟。

在 1956 年的达特茅斯会议上,人工智能”第一次被正式命名,人工智能由此诞生。

(第一届达特茅斯会议部分与会者,图自:中华网文化频道)

这让不少科学家开始起航,趋之若鹜地奔向人工智能领域,世界迎来了第一个人工智能大潮。在过去的 60 多年来,人工智能已经经历了两次大起大落,从 80 年代末到 90 年代初,由于经费削减和备受质疑,研究者们还经历了艰难的“AI 之冬”。

但就像《海贼王》里所说的,世代传承的意志,时代的变迁,人们的梦,只要人们继续追求答案,这一切的一切都将永不停止。

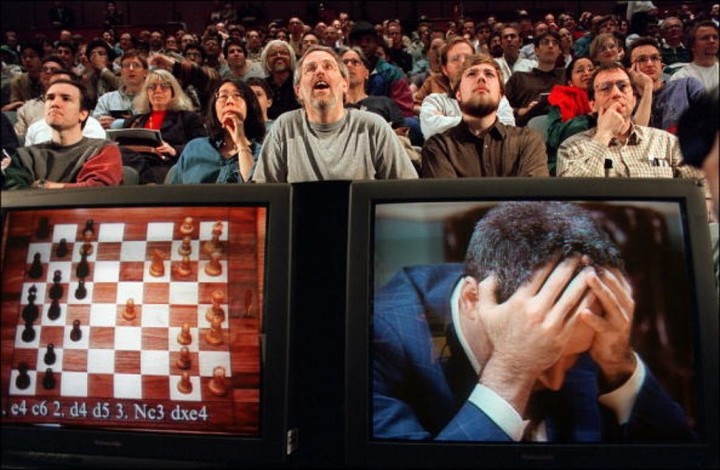

从 1997 年 IBM 的下棋程序“深蓝”击败了卡斯帕罗夫到 AlphaGo 战胜围棋选手李世石,今天,我们正处在第三次人工智能大潮之中。

(图自:Novinky)

而 Google 无疑是其中的佼佼者,近几年 Google 把不少出色人工智能公司收入囊中,其中就包括以 6.5 亿美元买下发明 AlphaGo 的 DeepMind,还组建了 Google Brain 团队专攻人工智能技术的研究,并以此向智能家居和无人车等领域拓展 。李开复在题为《人工智能的黄金时代》的演讲中这样评价 Google 在人工智能上的前景:

对于 Google,我们千万不要低估了它的能力,因为这家公司可能是未来推动人工智能平台化的最大力量。

在国内,百度已经把人工智能当做自己未来的核心战略方向,不少公司也纷纷跟进,有投资人称人工智能或成为新的风口。而在前几天的 2017 年人工智能电脑视觉产业创新大会上,工信部也明确指出把人工智作为重大国家战略来策略部署,还要从四个方面推动人工智能发展。

(图自:第一财经)

(图自:第一财经)

随着人工智能迎来前所未有的热潮,对人工智能的争论也达到新的高潮,毕竟在风口至上,相比起投资人工智能的资金,对人工智能安全研究的投入显得微不足道。

那么马斯克们对人工智能的担忧到底是先见之明还是杞人忧天呢?

人工智能带给人类的,是永生还是灭绝?

在《名利场》那篇文章中,马斯克举了一个人工智能可能占领地球的例子:一开始人类可能只是创造了一个人工智能来摘草莓,但随着这个人工智能越干越好,它会为了更好地完成摘草莓可能会把全世界都变成草莓园,并把阻碍它完成目标的障碍(包括人类)一一消除。

这个观点并不是第一次被提出,Wait But Why 网站的创始人 Tim Urban 在一篇论述人工智能的文章中,也举了类似的一个例子,一个被设定为模仿人类写字的人工智能系统为了更好地写字最终杀光了人类。

(图自:Taringa)

这看起来好像只是脑洞大开,实际上如果上述例子要成为现实,至少也要达到强人工智能的程度,而目前大部分人工智都处在弱人工智能的阶段。目前主流的观点认为人工智能可以分为三个阶段:

- 弱人工智能 (Artificial Narrow Intelligence ):弱人工智能拥有强大的计算能力,但只在某方面强于人类,比如 Siri 和 AlphaGo。

- 强人工智能(Artificial General Intelligence) : 强人工智能在各方面都能达到人类的水平,包括能以批判性思维和抽象思维思考问题,但目前还没有人工智能可以做到。

- 超级人工智能(Artificial SuperIntelligence):按照 Nick Bostrom 的说法,超级人工智在几乎所有领域都比最聪明的人类大脑都聪明很多,包括科学创新、通识和社交技能。

(图自:The Next Tech)

被称为”人工智能之父“的图灵,曾经提出一个关于判断机器是否能够思考的著名试验,并创立了一个勒布纳人工智能奖(Loebner prize),旨在奖励能通过图灵测试的程序,由于目前为止还没有谁能获得最高奖项,只能把奖项颁给最接近的程序,如聊天机器人 Mitsuku。

马斯克等持人工智能威胁论者真正担心的其实是超级人工智能,但在人工智能连图灵测试都无法通过的今天,担心遥不可及的超级人工智能是不是太早了?

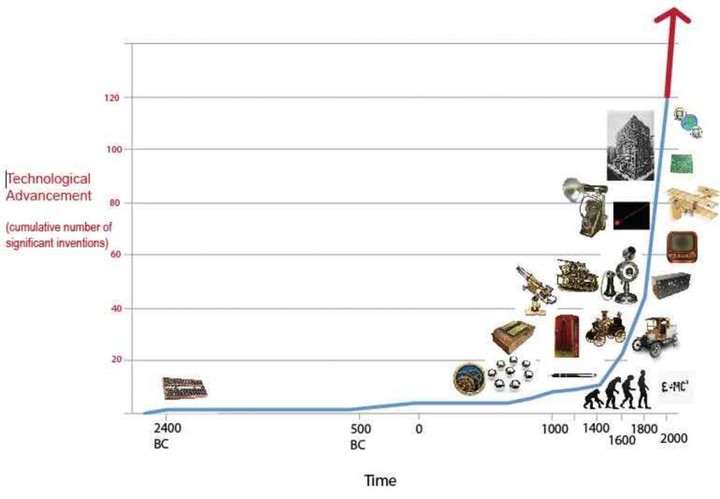

但未来学家 Ray Kurzweil 曾经提出一个加速回报定律(Law of Accelerating Returns),试图证明这一天的到来会比我们想象中要快得多。

根据这个理论,技术改良以过去的成就为基础,每十年革新的步调会加倍。按照加速回报定律,Kurzweil 认为人类科技水平在 21 世纪的进步将是 20 世纪的 1000 倍。

(加速回报定律示意图,图自:wordpress)

而对于人工智能,也有人提出过一个类似的概念——递归的自我提升。这个理论认为人工智能具有自我提升的机制,每一次提升都会比上一更次容易,最终达到指数级的提升,超级人工智能将会出现,达到人类也再也无法理解的技术奇点。

在今年 2 月马斯克、霍金等科学家推进的阿西洛马人工智能原则中,就包括了“人工智能这种快速自我提升的的方式必须受制于严格的安全和控制标准”。

但无论是加速回报定律,还是递归的自我提升,这些观点在学界和业界都备受争议,正如人们对人工智能的争论。

人工智能思想家 Nick Bostrom 曾在 2013 年对数百位科学家做了问卷调查,问卷的内容是“你预测人类级别的强人工智能什么时候会实现”,有一半科学家认为强人工智能出现的中位年份是 2040 年,而 75%的科学家认为在达到强人工智能后 30 年内就会出现超级人工智能。

(《西部世界》中的机器人,图自:Giphy)

Nick Bostrom 希望证明人类试图理解超级人工智能终究的徒劳无功的,当人工智能发展到比人类智力水平高出几个量级,人类对抗人工智能就好像一只老鼠试图阻止人类发明捕鼠器一样。

这里要说明的是,传说中的超级人工智能可能不会像《终结者》和《西部世界》中的机器人一样“有血有肉”有情感,而是一个完全依赖算法的冷血物种,甚至不会有实体形态。正如马斯克所说:

人工智能的可怕之处不是它会化身机器人杀死人类,机器人本身只是一个终端传感器和执行器,人工智能形成算法在网络的无限扩散才是不可阻挡的。

Nick Bostrom 也曾提出过人工智能将核心代码上传到云服务器从而在世界范围内制造纳米机器人,然后不知不觉释放毒气来灭绝人类的设想。

(图自:TED Ideas)

人类不是没考虑过应对的方案,去年 6 月人工智能公司 DeepMind 就发表了一篇论文,为预防超级人工智能的反叛设计了一个方案,称只要人工智能一失控,人类只要按下一个“大红按钮”就能阻止人工智能。但如果超级人工智能真的如众多研究者所说的那么厉害,要破解人类这种伎俩也是轻而易举了。

关于人工智能,也有人认为有可能让人类摆脱肉体的限制,把自己的思维上传云端,通过人造的躯体达到永生,马斯克研究脑机连接的新公司就被认为有这种可能。这和众多人工智能威胁论形成两个极端,人工智能带给人类的,是永生还是灭绝?这或许是个无法证伪的命题。

题图来自:《名利场》