顺着霍金的话问一句:人类是否注定要自我毁灭?

电影《2012》曾让整个世界陷入一场长达数年的“末日狂热”,尽管只是一部虚构的电影,丝毫不妨碍几亿人在社交网络上以此取乐,就像在玩蹦极一样,享受着一种明知道不会死但又很刺激的愉悦。

而几年后,末日预言走出了好莱坞,走入了科技圈。前不久火星男马斯克放言称人类必须尽快移民火星,这样才能避免科技在战争中倒退。如今又走进了科学圈,宇宙学家霍金也开始预言地球的末日,部分思想竟与马斯克遥相呼应:

尽管地球遭遇灾难的几率很低,但这几率随时间增长,在下一个千年或者万年几乎将成为必然事件。

那时候我们已经开始开拓太空,在外星殖民,因此地球的末日不意味着人类的终结。

据 QZ 报道,世界上许多著名的科学家都在发声示警,人类在建立外星殖民地之前应该格外小心,别在那天之前就自我毁灭了。霍金对于星星撞地球之类的灾难只是轻描淡写地提了一嘴,显然他更担心的也是人类的自毁能力:

科学和科技的进步固然不能停止,但我们必须认识到其中的危险并加以控制……全人工智能的发展足以让人类灭绝。

人工智能是创世的种子还是灭世的根源(链接是杨青山的相关文章)?这是每一个人工智能专家最不愿回答的问题——技术没影,多说无益。既然缺乏定论,我们可以把大问题拆成小问题,大胆揣测一番。

首先做一个假设:科技不是障碍,人工智能要多智能就有多智能。在这个前提下,人工智能可以在两种情况下灭绝人类:

- 人工智能反客为主 – 人工智能统治了世界,以人为奴,或者把人类屠杀殆尽;

- 人工智能成为武器 – 人类用人工智能武器打仗,毁灭了世界。

然后,把第一种情况留给科学家,单说一下第二种情况。基于这一系列的假设,现在可以把原来的问题表述得很简单:

在有可能的情况下,人类是否会把先进科技用在武器上?

人类的兵器史说来很长,也可以简短总结为三次兵器革命:没兵器-冷兵器-火药兵器-核武器。

火药与人工智能很相似,不是为战争而生,却能被战争所用。一千多年前,我国古代的炼丹术士为追求长生搞过无数的化学实验,其中一项是“以硫磺、雄黄合硝石,并蜜烧之”,诞生了火药的雏形。

到唐朝,火药上了战场,在一种叫做“火箭”的管状武器中燃起一团火球,飞火焚烧敌营。到南宋,火器跳脱了唐代的局限性——不光利用火药的燃烧性,还开始利用火药引爆带来的气压,因此有了火铳。在中国发明火药近千年后,英国人(有争议地)也发现了火药,最初是作为染料使用,后来被广泛应用于军事,成为了西方国家的战争利器。

我国发明火药的契机是神秘主义追求的长生不老,英国发明火药的契机是一次工业领域的试验。火药之前的冷兵器源自生产力工具(如锄头),火器之后的核武器源自对新能源的探索。总之,只要能增强战斗力的科技,都会成为武器,而且这武器还会在实战中不断进化。

世界大战就像是一次次武器博览会,各个国家拿出自己的看家本领与他国一较高下。不打还好,一旦打了,战后全球的战争艺术都会更上一层楼。

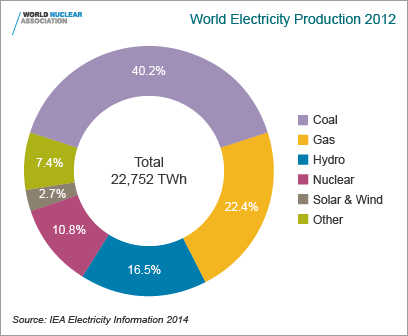

纵观人类兵器的三次革命,技术最初都非为战争而研发,却无一例外为战争所用。先不说什么原罪,这些科技虽然都上了战场,战争也让科技得到传播,以生存压力迫使各国进行研究。战争过后,各国军事实力达到相对均衡后,战争科技又会重新变成和平科技。据世界核能组织数据,截至 2015 年全球核电占比已超过 10%。

不过,从来没有一项科技是被世界各国同时掌握的,军事的“威胁均衡”又谈何容易?

人工智能与火药、核武器自有不同,但若均待之为一项科技,大抵逃不出“和平用途-战争用途-和平用途”的轮回。私以为只要可能,任何科技都必然被应用于战争,人工智能也不例外。纵使如此,人工智能的发展不以反战思想为牢笼,它将在更为强大的科技原动力推动下继续前行,不确定的未来总有确定到来的一天。而我们只能祈祷,那时的人们会“认识到其中的危险并加以控制”。

理论上只要人没有死光,人类总会继续繁殖,文明也总能在倒退后复兴、前进。然而战争不仅祸及人类文明,更是一次次地刺伤着地球,至今为止,地球尚未以全球性自然灾害降罪于人类。怕的是地球有个忍耐的极限,而人类一直走不出那个轮回。

基于前述假设,终极问题来了:

在人工智能被用于下一次大战之后,我们是否能活着等到它回归和平用途呢?

或者换个形而上的问法:

人类是否注定要自我毁灭?