Deepfakes 掀起了一场反伪造照片和视频的竞赛。

自 Deepfakes 出现以来,人们日渐意识到这种极容易使用,且作品变得越来越难甄别真假的技术,是一项不容忽视的挑战。

现在,如果是人工判断,合成视频还算比较好辨别,但(肉眼可辨真假的)窗口正在快速收紧。按我预测,只需 12 个月,我们就会迎来肉眼无法区别真假的视频。

到时候,整个社会都会进入一个对内容失去信任的情况状态。

创业公司 Truepic CEO Jeffrey McGregor 说道。

为了应对,Trupic 和部分创业公司希望将造假「扼杀于摇篮」。

Truepic 的技术可自动为照片加上时间和地点信息,并提供相关真假信息确认。而另一创业公司 Serelay 则会在图片上添加拍照时手机和附近信号塔或 GPS 卫星距离信息。据悉,Serelay 在和一家保险公司合作,用此技术判别索赔图片信息的真伪。

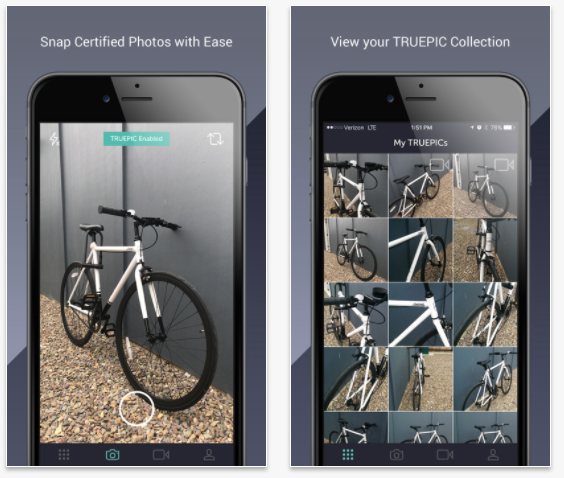

▲ Truepica app

美国国防部则在研发更通用的「图片/视频鉴证技术」。

简单来说,图片鉴证主要通过寻找照片中不协调的地方,譬如不合理的光影和噪音点。如果要处理更高级算法做出来的假照片,专家就得从人的表情入手,寻找看起来不自然的地方。国防部正致力将这种原本只能让人来判别的工作算法自动化。

▲ 图片来自 TechXP

问题是,Deepfakes 这类算法的本质就很「反算法鉴证」,因为它包括两部分,一部分负责生成图片,另一部分则负责判断这个图片看起来是否足够真实,且在不断优化。

譬如,在 2018 年 6 月,研究人员发现 Deepfakes 在生成人类「眨眼」上存在缺陷,因此,特定侦查算法能轻松凭此辨别视频真伪。然而,没过多久,人们就开始将眨眼动作的合成技术更新到算法中,从前的侦查算法就无效了。

现在,这个问题已经引起美国政府和行业的关注,他们都在发力寻找应对方案,尤其当 2020 年的美国总统选举已经近在咫尺。

在这个「反伪造」的大势下,「修图鼻祖」Adobe 作为全球最大的消费级修图软件供应商,很早就开始和美国国防部合作,开发帮助判断图片真伪的工具。

我们对于 Photoshop 和其它 Adobe 创意工具在世界上的影响力感到很自豪,但同时也意识到我们科技潜在的道德延伸影响。虚假内容已成为了一项日益紧迫的严重问题。

虽然「反伪」工具很必要,但它们未必能根除问题。

James Vincent 在《The Verge》文章中指出:假视频就和假新闻一样,即便大部分人能够轻易看出它们是假的,但它们仍很可能被广泛传播。

题图来自 Inverse